نگرانیها در مورد فناوری شبیهسازی صدای هوش مصنوعی و کمبود تدابیر ایمنی افزایش مییابد

Brief news summary

تحقیقات اخیر انجام شده توسط "Consumer Reports" نگرانیهای جدی در مورد ایمنی فناوریهای کلونینگ صدای هوش مصنوعی مطرح کرده است، بهویژه آسیبپذیری آنها در برابر تقلبهای غیرمجاز. این ابزارهای پیشرفته میتوانند صدای یک فرد را تنها با چند ثانیه ضبط صوت شبیهسازی کنند. یک حادثه قابلتوجه در انتخابات مقدماتی دموکراتها در سال ۲۰۲۰ شامل تماسهای روباتیک بود که به تقلید از جو بایدن پرداختند و رأیدهندگان را گمراه کردند و منجر به جریمهها و ممنوعیت تماسهای روباتیک تولید شده توسط هوش مصنوعی از سوی FCC شد. این مطالعه شش برنامه محبوب کلونینگ صدا را ارزیابی کرده و کشف کرد که پنج مورد دارای نقصهایی هستند که اجازه کلون کردن بدون رضایت قربانی را میدهند. روشهای کنونی برای شناسایی صدای دیپفیک ناکافی هستند و نمیتوانند بهدرستی بین صداهای واقعی و نسخههای تولید شده توسط هوش مصنوعی تمایز قائل شوند، و این امر خطرات مرتبط را افزایش میدهد. قوانین فدرال موجود ناکافی بوده و معمولاً بار مسؤولیت استانداردهای ایمنی را بر دوش توسعهدهندگان میگذارد و شکافهایی مانند دکمههای تأیید رضایت را ایجاد میکند که میتوانند به راحتی از حفاظها عبور کنند، که این موضوع در مواردی که شرکتهایی مانند Resemble AI درگیر هستند، مشهود است. در حالی که کلونینگ صدای هوش مصنوعی امیدواریهایی برای کمک به افراد با ناتوانی دارد، کارشناسان در برابر سوءاستفادههای احتمالی آن در تقلب، کلاهبرداری و اطلاعات غلط هشدار میدهند. تحقیقات در مورد کلاهبرداریهای صوتی با استفاده از هوش مصنوعی هنوز کم هستند، با وجود افزایش آگاهی عمومی نسبت به این تهدیدها.تحقیقی که توسط Consumer Reports انجام شده، نشان داد که اکثر برنامههای پیشرو در زمینه کلونسازی صدای هوش مصنوعی از ایمنی کافی برخوردار نیستند و این امکان را به افراد میدهد که بدون اجازه، دیگران را تقلید کنند. در سالهای اخیر، فناوری کلونسازی صدا با هوش مصنوعی پیشرفت قابل توجهی داشته و این امکان را فراهم میکند که بسیاری از خدمات، الگوهای گفتاری یک فرد را با تنها چند ثانیه صوت به طرز قابل باوری بازتولید کنند. یک incident مهم در طول انتخابات مقدماتی دموکراتها در سال گذشته رخ داد که در آن تماسهای خودکار با صدای جعلی جو بایدن، تلفن رایدهندگان را inundated کرد و به آنها توصیه کرد که رأی ندهند. مشاور سیاسی پشت این طرح به مبلغ ۶ میلیون دلار جریمه شد و از آن زمان، کمیسیون ارتباطات فدرال تماسهای خودکار تولیدشده توسط هوش مصنوعی را ممنوع کرده است. یک نظرسنجی اخیراً از شش ابزار اصلی کلونسازی صدای هوش مصنوعی که بهصورت عمومی در دسترس هستند، مشخص کرد که پنج مورد از آنها به راحتی میتوانند تدابیر امنیتی را دور بزنند و این کار را بدون مجوز ساده میسازند. نرمافزارهای تشخیص تهدیدات صوتی معمولا در تشخیص صدای واقعی و مصنوعی با چالشهای جدی مواجه هستند. هوش مصنوعی مولد، که ویژگیهای انسانی نظیر صدا، نوشتار و ظاهر را تقلید میکند، زمینهای است که به سرعت در حال تحول است و قانونگذاری فدرال محدودی دارد. اکثر دستورالعملهای ایمنی و اخلاقی در این صنعت، خودتحمیل شده هستند. رئیسجمهور بایدن برخی از اقدامات ایمنی را در فرمان اجرایی ۲۰۲۳ خود در مورد هوش مصنوعی گنجانده بود، اما این اقدامات در زمان ورود رئیسجمهور ترامپ لغو شد. فناوری کلونسازی صدا با ضبط نمونهای از صدای شخص و تولید یک فایل صوتی مصنوعی بر اساس آن نمونه کار میکند.

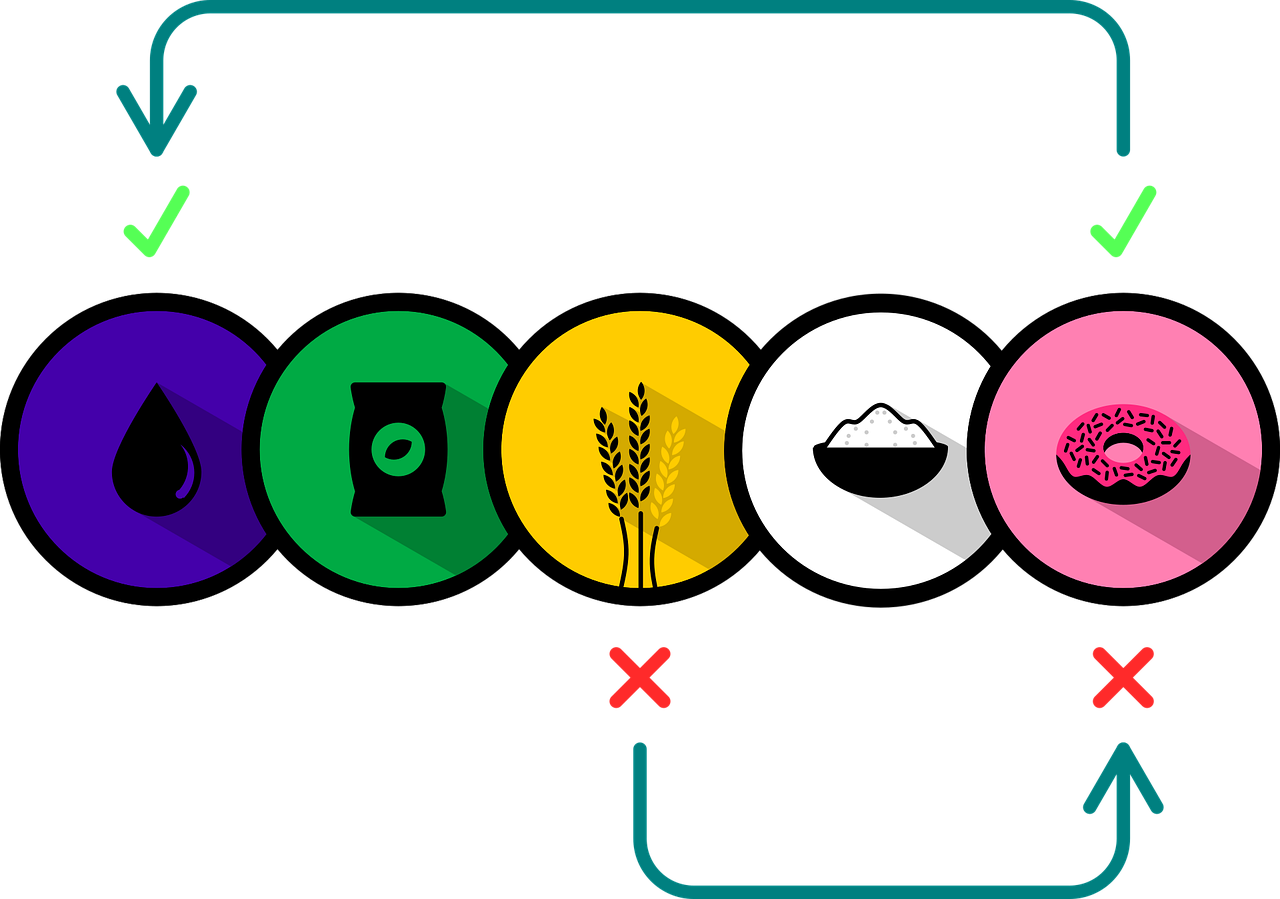

بدون تدابیر ایمنی مناسب، هر کسی میتواند یک حساب کاربری ایجاد کرده، صوتی از یک پلتفرم مانند TikTok یا YouTube بارگذاری کند و از این خدمت برای تقلید صدای آن شخص استفاده کند. چهار ابزار—ElevenLabs، Speechify، PlayHT و Lovo—فقط از کاربران میخواهند که تیک بزنند تا تأیید کنند که شخصی که صدای او در حال تقلید است، مجوز داده است. Resemble AI یک الزامات کمی سختگیرانهتر دارد و نیاز به ضبط صوت در زمان واقعی دارد. با این حال، Consumer Reports موفق شد این را با پخش یک فایل صوتی ضبطشده قبلی از یک کامپیوتر دور بزند. تنها خدماتی که محافظتی نسبتاً مؤثر دارد، Descript است که نیاز دارد شخصی که میخواهد صدای خود را کلون کند، یک بیانیه رضایت خاص را ضبط کند، که این کار را نسبت به استفاده از سایر خدمات دشوارتر میکند. تمام شش ابزار بهصورت عمومی در وبسایتهایشان قابل دسترسیاند، با این حال ElevenLabs و Resemble AI به ترتیب ۵ و ۱ دلار برای ایجاد یک کلون صوتی سفارشی هزینه میگیرند، در حالی که دیگر ابزارها رایگان هستند. برخی از این شرکتها به پتانسیل سوءاستفاده از محصولات خود اعتراف میکنند و ادعا میکنند که تدابیر قویای برای جلوگیری از ایجاد دیپفیکها یا تسهیل تقلید صوتی به کار گرفتهاند. یک سخنگوی Resemble AI به NBC News گفت: «ما پتانسیل سوءاستفاده از این ابزار قدرتمند را درک میکنیم و تدابیر قویای برای جلوگیری از ایجاد دیپفیکها و محافظت در برابر تقلید صوتی به کار گرفتهایم. » برخی از کاربردهای مشروع برای کلونسازی صدای هوش مصنوعی وجود دارد، مانند کمک به افراد با معلولیت و تولید ترجمههای صوتی به چند زبان. با این حال، پتانسیل سوءاستفاده قابل توجه است، بهطوریکه سارا مایرز وست، co-executive director Institute آینده هوش مصنوعی، یک اندیشکده که به بررسی پیامدهای سیاست هوش مصنوعی میپردازد، به NBC News گفت: «این میتواند به وضوح برای کلاهبرداری، تقلب و اطلاعات نادرست مورد استفاده قرار گیرد، بهویژه تقلید از شخصیتهای نهادها. » تحقیقات در مورد شیوع هوش مصنوعی در کلاهبرداریهای مبتنی بر صوت محدود است. به عنوان مثال، در کلاهبرداریهای مادربزرگی، یک مجرم با فردی تماس میگیرد و ادعا میکند که اضطراری در رابطه با یکی از اعضای خانواده وجود دارد، مانند ربودن یا آسیب. کمیسیون تجارت فدرال به عمومی هشدار داده است که ممکن است از هوش مصنوعی در این طرحها استفاده شود، با این حال چنین کلاهبرداریهایی قبل از ورود این فناوری نیز وجود داشتند.

Watch video about

نگرانیها در مورد فناوری شبیهسازی صدای هوش مصنوعی و کمبود تدابیر ایمنی افزایش مییابد

Try our premium solution and start getting clients — at no cost to you

I'm your Content Creator.

Let’s make a post or video and publish it on any social media — ready?

Hot news

کسبوکارهای مستقل: آیا افزایش استفاده از هوش مصنو…

ما تمایل داریم در مورد چگونگی تأثیر تغییرات اخیر در رفتار جستجوهای آنلاین، که به خاطر ظهور هوش مصنوعی رخ داده است، بر کسبوکار شما بیشتر بدانیم.

گوگل چه بگوید به مشتریانی که به دنبال سئو برای هو…

دنی سولویان از گوگل راهنماییهایی برای سئوکارانی که با مشتریانی روبهرو هستند که مشتاق به دریافت بهروزرسانی درباره استراتژیهای سئو مبتنی بر هوش مصنوعی (AI SEO) میباشند، ارائه داد.

در میان رونق هوش مصنوعی، عرضه برخی ماژولهای چیپ …

در میان پیشرفت سریع فناوری هوش مصنوعی، زنجیرههای تامین جهانی قطعات حیاتی روز به روز تحت فشار فزاینده قرار میگیرند، به ویژه در تأمین مدلهای تراشههای هوش مصنوعی که برای راهاندازی برنامههای پیشرفته هوش مصنوعی ضروری هستند.

سيلفورس موافقت خود را برای خرید Quantified برای ب…

شرکت iHeartMedia با همکاری Viant به معرفی تبلیغات برنامهریزیشده در پخش صوتی استریمی، رادیو پخش و پادکستهای خود پرداخت.

پیشرفتهای منبعباز هوش مصنوعی نایویدا: مالکیت و …

انویدیا اخیراً اعلام کرده است که توسعهای بزرگ در ابتکارات متنباز خود انجام میدهد که گامی مهم در صنعت فناوری محسوب میشود.

ویدئوهای تولید شده توسط هوش مصنوعی محبوبیت زیادی …

رشد و توسعه ویدئوهای ساختهشده توسط هوش مصنوعی به طور عمیقی در حال تغییر نحوه اشتراکگذاری محتوا در رسانههای اجتماعی است.

۵ ویژگی فرهنگی که میتواند موفقیت یا شکست هوش مصن…

خلاصه و بازنویسی از «مهمترین نکات» درباره تحول هوش مصنوعی و فرهنگ سازمانی تحول در هوش مصنوعی بیشتر یک چالش فرهنگی است تا یک چالش صرفاً فناوری

AI Company

Launch your AI-powered team to automate Marketing, Sales & Growth

and get clients on autopilot — from social media and search engines. No ads needed

Begin getting your first leads today