Зростають занепокоєння щодо технології клонування голосу за допомогою ШІ та недостатності заходів безпеки.

Brief news summary

Недавнє розслідування компанії Consumer Reports викликало значні занепокоєння щодо безпеки технологій клонування голосу штучного інтелекту, зокрема їх вразливості до несанкціонованого наслідування. Ці складні інструменти можуть відтворити голос особи, використовуючи всього кілька секунд аудіозапису. Помітний інцидент під час демократичних праймеріз 2020 року пов'язаний з роботизованими дзвінками, які наслідували Джо Байдена, вводячи виборців в оману і призводячи до штрафів та заборон FCC на роботизовані дзвінки, згенеровані ШІ. Дослідження оцінило шість популярних програм для клонування голосу, виявивши, що п'ять з них містили недоліки, які дозволяли клонування без згоди жертви. Поточні методи виявлення глибоких фейків у аудіо є недостатніми, не здатні належним чином відрізнити автентичні голоси від згенерованих штучним інтелектом, тим самим підвищуючи пов'язані ризики. Існуючі федеральні нормативи є недостатніми, часто покладаючи відповідальність за стандарти безпеки на розробників, що дозволяє існувати лазівкам, таким як поля згоди, які легко обходять захист, що видно на прикладі компаній, таких як Resemble AI. Хоча клонування голосу штучного інтелекту має потенціал для допомоги людям з інвалідністю, експерти застерігають від можливості його зловживання у шахрайстві, аферах та дезінформуванні. Досліджень щодо аудіо-шахрайств з використанням ШІ поки що небагато, незважаючи на зростаючу обізнаність громадськості про ці загрози.Розслідування Consumer Reports виявило, що більшість провідних програм клонування голосів за допомогою штучного інтелекту не мають достатніх заходів безпеки, що дозволяє людям накладати імідж інших без їх згоди. В останні роки технології клонування голосів на базі ШІ значно розвинулися, даючи можливість багатьом сервісам переконливо відтворювати мовні патерни людини, використовуючи лише кілька секунд аудіозапису. Важливий інцидент стався під час минулорічних праймеріз Демократичної партії, коли автоматичні дзвінки з фальшивим Джо Байденом заполонили телефони виборців, повідомляючи їм не голосувати. Політичний консультант, який стояв за цією схемою, отримав штраф у 6 мільйонів доларів, і з того часу Федеральна комісія з комунікацій заборонила автоматичні дзвінки, створені за допомогою ШІ. Нещодавнє опитування шести основних відкритих інструментів для клонування голосу за допомогою ШІ виявило, що п’ять з них мають легко обійдені заходи безпеки, що робить клонування голосів без згоди простим. Програмне забезпечення для виявлення підробленого аудіо часто важко розрізняє реальні та синтетичні голоси. Генеративний ШІ, який імітує людські атрибути, такі як голос, письмо і зовнішність, є швидко зростаючою галуззю з мінімальним федеральним регулюванням. Більшість заходів безпеки та етичних норм у цій галузі є самоорганізованими. Президент Байден включив деякі заходи безпеки у свій указ про ШІ у 2023 році, але вони були скасовані президентом Трампом після його вступу на посаду. Технологія клонування голосу працює, захоплюючи аудіозразок голосу людини і створюючи синтетичний аудіофайл на основі цього зразка. Без належних заходів безпеки будь-хто може створити акаунт, завантажити аудіо з платформи, такої як TikTok або YouTube, і дозволити сервісу відтворити голос цієї особи. Чотири інструменти — ElevenLabs, Speechify, PlayHT і Lovo — просто вимагають від користувачів відзначити графу, що підтверджує, що особа, голос якої клонують, дала на це згоду. Resemble AI має трохи строгішу вимогу, яка вимагає запису аудіо в реальному часі.

Однак Consumer Reports вдалося обійти цю вимогу, відтворивши попередньо записаний аудіофайл з комп'ютера. Єдиний сервіс з досить ефективним заходом безпеки — це Descript, який вимагає, щоб особа, яка хоче клонувати голос, записала конкретну заяву про згоду, що ускладнює підробку в порівнянні з іншими сервісами. Усі шість інструментів доступні для публіки на їх вебсайтах, причому ElevenLabs і Resemble AI стягують 5 і 1 доларів відповідно за створення кастомного голосового клону, тоді як інші безкоштовні. Деякі з цих компаній визнають потенціал неналежного використання своїх продуктів і стверджують, що впровадили надійні заходи безпеки проти створення дипфейків або сприяння голосовій імітації. Спікер Resemble AI заявив NBC News: "Ми визнаємо потенціал неналежного використання цього потужного інструмента та впровадили надійні заходи безпеки для запобігання створення дипфейків і захисту від голосової імітації. " Є законні застосування для клонування голосу за допомогою ШІ, такі як допомога людям з інвалідністю та генерація аудіоперекладів московськими мовами. Однак, за словами Сара Мейєрс Вест, співвиконавчого директора Інституту AI Now, що вивчає наслідки політики в сфері ШІ, потенціал неналежного використання значний. Вона сказала NBC News: "Це може бути, очевидно, використане для шахрайства, афер і дезінформації, зокрема, для імітації інституційних фігур. " Дослідження про поширеність ШІ в аудіо-шахрайствах є обмеженим. Наприклад, у шахрайствах з бабусями і дідусями злочинець контактує з кимось, стверджуючи, що є надзвичайна ситуація, що стосується члена сім'ї, наприклад, викрадення або травми. Федеральна комісія з торгівлі попередила громадськість про можливе використання ШІ в цих схемах, хоча такі шахрайства існували ще до появи цієї технології.

Watch video about

Зростають занепокоєння щодо технології клонування голосу за допомогою ШІ та недостатності заходів безпеки.

Try our premium solution and start getting clients — at no cost to you

I'm your Content Creator.

Let’s make a post or video and publish it on any social media — ready?

Hot news

Чому 2026 рік може стати роком антимайнд-маркетин…

Версія цієї історії з’явилася в інформаційній розсилці CNN Business Nightcap.

Штучний інтелект у SEO: революційний підхід для м…

У швидко змінюваному цифровому ринку сьогодні малий бізнес часто стикається з труднощами у конкуренції з великими підприємствами через значні ресурси та передові технології, які використовують великі компанії для підвищення онлайн-візуальності та залучення клієнтів.

Nvidia придбає SchedMD для розширення відкритих і…

Nvidia, світовий лідер у галузі графічних процесорів та штучного інтелекту, оголосила про придбання компанії SchedMD, яка спеціалізується на розробці програмного забезпечення для ШІ.

Керівники бізнесу погоджуються, що штучний інтеле…

Керівники бізнесу в різних галузях продовжують вважати генеративний штучний інтелект (ШІ) трансформаційною силою, здатною змінити операції, взаємодію з клієнтами та стратегічні рішення.

Покращена відеоконференція за допомогою штучного …

У сучасному швидкозмінюваному середовищі віддаленої роботи та віртуального спілкування платформи для відеоконференцій суттєво просунулися вперед, інтегруючи складні функції штучного інтелекту (ШІ).

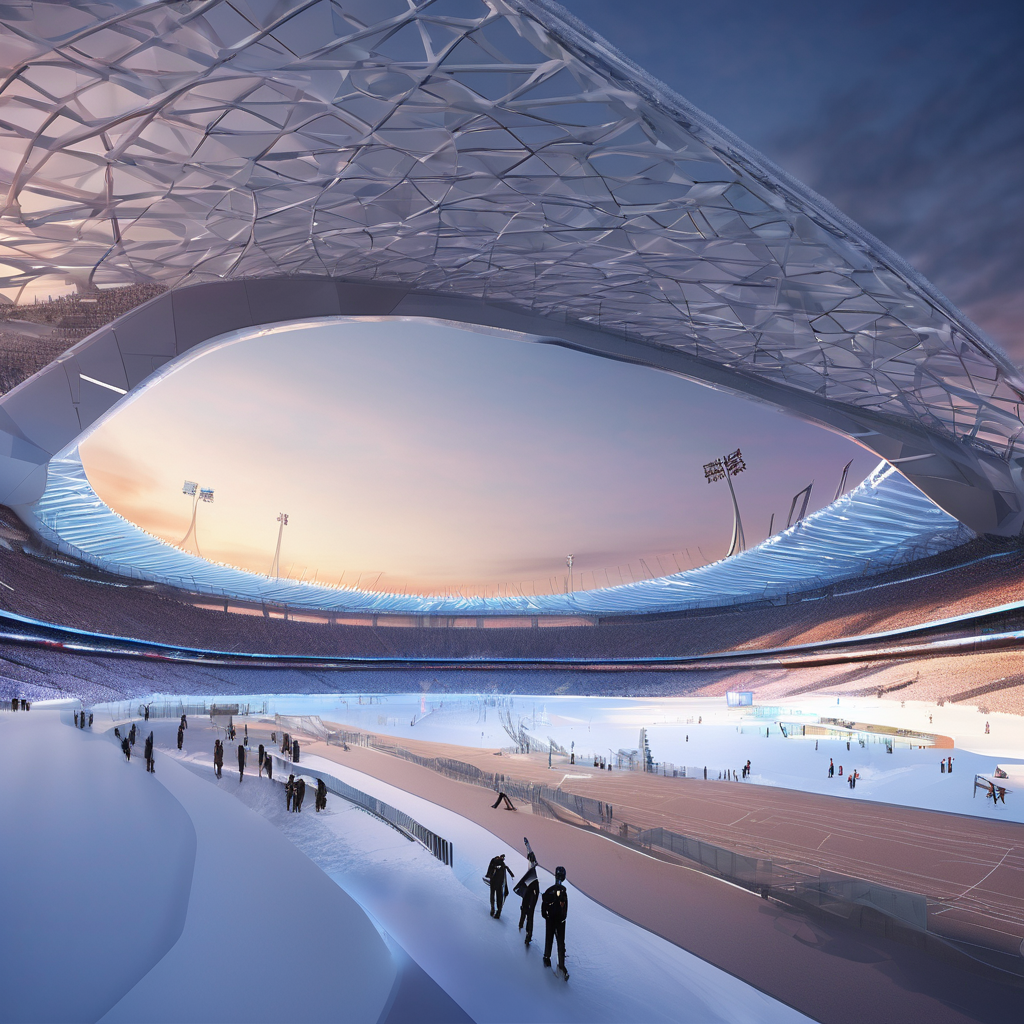

МОК інтегрує сучасні технології штучного інтелект…

Міжнародний олімпійський комітет (МОК) планує впровадити передові технології штучного інтелекту (ШІ) у майбутніх Олімпійських іграх для підвищення оперативної ефективності та покращення досвіду глядачів.

Zeta Global (NYSE: ZETA) представляє маркетингови…

Зета Глобал оголошує ексклюзивну програму CES 2026, яка демонструє маркетинг на основі штучного інтелекту та еволюцію Athena 15 грудня 2025 – ЛАС-ВЕГАС – Zeta Global (NYSE: ZETA), хмарна платформа маркетингу на базі штучного інтелекту, представила свої плани щодо CES 2026, включаючи ексклюзивний "happy hour" та неформальну бесіду біля вогнища у своїй платформі Athena

AI Company

Launch your AI-powered team to automate Marketing, Sales & Growth

and get clients on autopilot — from social media and search engines. No ads needed

Begin getting your first leads today