Défis éthiques de l'IA autonome : responsabilité, transparence et biais

Brief news summary

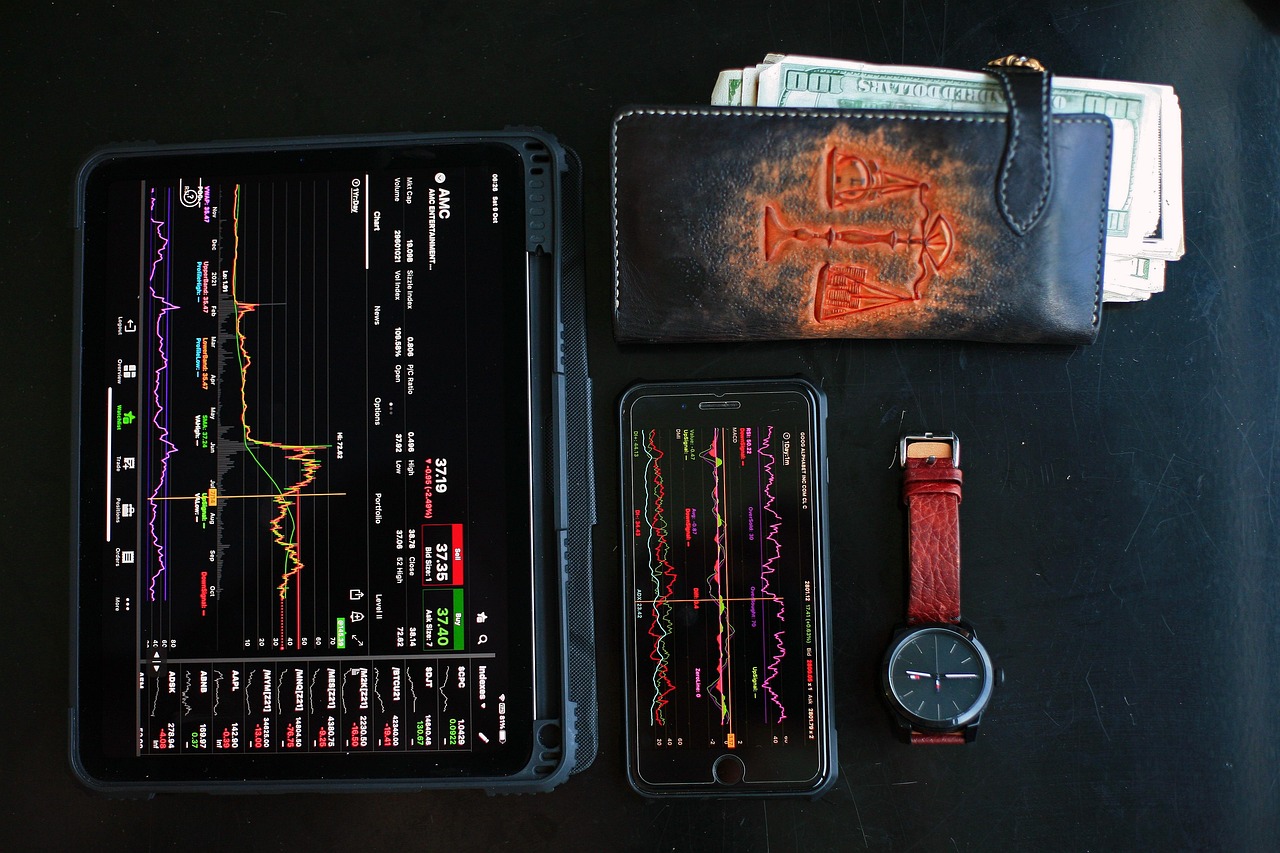

À mesure que les systèmes d'IA deviennent de plus en plus autonomes dans des domaines critiques tels que la santé, la finance et le transport, les préoccupations éthiques concernant la responsabilité, la transparence et les biais s'intensifient. Garantir une responsabilité claire pour les décisions prises par l'IA — notamment lorsqu'un préjudice survient — nécessite la mise à jour des cadres juridiques et réglementaires. De nombreux modèles d'IA fonctionnent comme des "boîtes noires" opaques, ce qui nuit à la confiance et souligne la nécessité de techniques d'explicabilité de l'IA. Les biais présents dans les données d'apprentissage risquent de perpétuer les inégalités sociales et de nuire aux groupes marginalisés, rendant indispensable un design équitable et une gestion attentive des données. Les experts appellent à l'élaboration de lignes directrices éthiques complètes et à des réglementations solides, créées en collaboration par les décideurs politiques, les développeurs et diverses parties prenantes, afin de suivre le rythme des avancées de l’IA. Instaurer la confiance du public par la transparence, la responsabilité, l’éducation et le dialogue ouvert est essentiel pour une intégration positive de l’IA dans la société. Aborder de manière responsable ces défis éthiques est crucial pour réaliser le potentiel transformatif de l’IA au service du bien commun.Alors que les systèmes d'intelligence artificielle (IA) progressent et atteignent une autonomie accrue, les préoccupations éthiques sont devenues au cœur des discussions sur leur impact. La capacité croissante de l’IA à prendre des décisions indépendantes dans divers secteurs — tels que la santé, la finance, les véhicules autonomes et la justice pénale — rend l abord des défis éthiques plus urgent que jamais. Les enjeux principaux incluent la responsabilité, la transparence et les biais dans la prise de décision de l’IA. La responsabilité est cruciale puisque les systèmes d’IA fonctionnent avec une autonomie importante. Lorsqu’une décision provient d’un algorithme plutôt que d’un humain, déterminer qui est responsable des résultats, notamment s’ils sont nuisibles ou non intentionnels, devient complexe. Par exemple, en cas d’accident de véhicule autonome, identifier si le constructeur, le développeur logiciel ou l’opérateur est responsable soulève des dilemmes juridiques et moraux. Cela nécessite des réformes législatives et une réévaluation des cadres de responsabilité dans les contextes d’IA. La transparence constitue un autre enjeu éthique essentiel. Beaucoup de modèles d’IA, en particulier ceux basés sur l’apprentissage profond, fonctionnent comme des « boîtes noires », avec des processus internes et des critères de décision que même leurs créateurs peinent à interpréter. Cette opacité sape la confiance des utilisateurs et des régulateurs et complique la supervision. Renforcer la transparence implique de développer des méthodes pour expliquer le raisonnement de l’IA dans des termes accessibles, renforçant ainsi la responsabilité et permettant une meilleure gouvernance. Les biais présents dans les algorithmes d’IA posent un problème répandu pouvant renforcer les inégalités sociales. Étant donné que l’IA apprend à partir de données historiques, tout préjugé incorporé peut conduire à des résultats discriminatoires, affectant de manière disproportionnée les groupes marginalisés.

Par exemple, une IA utilisée pour le recrutement ou l’octroi de crédits pourrait désavantager certains profils démographiques. Atténuer ces biais exige une sélection rigoureuse des ensembles de données, une surveillance continue et l’intégration de l’équité comme principe fondamental de conception. Les experts insistent sur la nécessité de lignes directrices éthiques claires et de cadres réglementaires robustes pour relever ces défis efficacement. De telles structures établiraient des normes pour les développeurs et les organisations, garantissant que les considérations éthiques imprègnent l’intégralité du cycle de vie de l’IA. Les décideurs politiques et les leaders de l’industrie doivent collaborer pour élaborer des réglementations qui suivent le rythme de l’innovation rapide en IA, afin de protéger les intérêts sociétaux sans devenir obsolètes. La complexité des enjeux éthiques liés à l’IA nécessite une approche interdisciplinaire mobilisant l’informatique, le droit, la philosophie, la sociologie et la politique publique. Cette collaboration favorise la diversité des perspectives, facilitant des solutions d’IA à la fois globales et humaines. Construire la confiance du public est essentiel pour une adoption large et bénéfique de l’IA. Sans certitude quant à une mise en œuvre éthique, la résistance sociale pourrait freiner les avancées. La transparence, la responsabilité et l’équité forment la base de cette confiance, qui peut être renforcée par l’éducation et un dialogue public ouvert afin de clarifier les bénéfices et les risques de l’IA. En résumé, à mesure que les systèmes d’IA deveniennent plus autonomes, il est crucial d’aborder leurs enjeux éthiques. L’établissement de normes éthiques solides, de cadres réglementaires et la promotion d’une coopération interdisciplinaire contribueront à assurer un développement et une utilisation responsables de l’IA. Cette approche permet à la société de tirer parti du potentiel transformatif de l’IA tout en en atténuant les risques, guidant ainsi la technologie vers le service du bien commun.

Watch video about

Défis éthiques de l'IA autonome : responsabilité, transparence et biais

Try our premium solution and start getting clients — at no cost to you