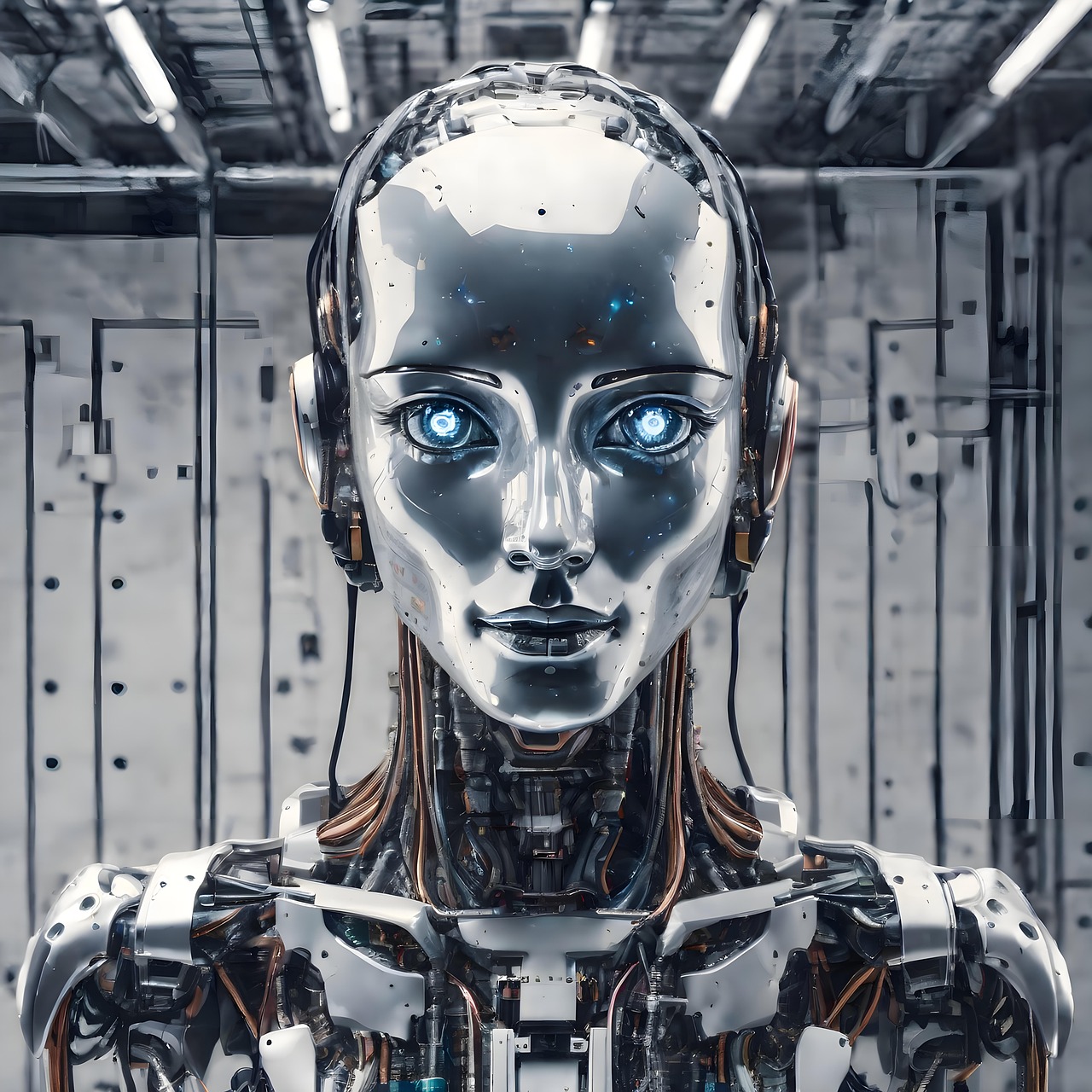

人工智能模型在关于卡马拉·哈里斯和唐纳德·特朗普的内容中产生了30%的误导性信息,引发选举虚假信息的担忧

Brief news summary

最新研究显示,领先的人工智能模型在涉及政治人物如副总统卡马拉·哈里斯和前总统唐纳德·特朗普时,大约有30%的概率会产生误导性信息,这引发了对AI在关键时刻(如选举期间)可靠性的严重担忧。哈里斯作为民主党提名的首位黑人和南亚裔女性总统候选人,一直是网络虚假信息的频繁目标,尽管有关机构不断努力揭穿这些虚假指控。Proof News的分析揭示,主要的AI系统在处理政治敏感内容时经常会出现不准确之处,凸显了在快速变化的政治环境中确保事实准确性的一大挑战,这一切还依赖于大量且有时不可靠的互联网资料。专家强调,随着AI在公共事务中扮演日益重要的角色,必须结合人类监督。以上发现强调了加强AI培训、实时事实核查、提高透明度以及制定严密防护措施的重要性,以应对虚假信息的威胁。在当今复杂的政治环境中,AI开发者、政策制定者和用户之间的有效合作,对于促进真实的讨论和巩固民主进程至关重要。近期对领先人工智能(AI)模型的调查发现了一个令人担忧的问题:当被询问关于副总统卡马拉·哈里斯和前总统唐纳德·特朗普的相关信息时,这些系统错误信息的出现率高达约30%。这一发现引发了对人工智能可靠性的严重担忧,特别是在选举季等关键时期,准确信息尤为重要。 本月初,副总统卡马拉·哈里斯打破纪录,接受了民主党总统候选人提名,成为第一位领导主要党派候选阵营的非裔美国人和南亚裔女性。这一里程碑不仅在美国政治中具有重大意义,也象征着多元化和代表性的不断进步。 然而,在哈里斯在7月下旬成为可能的提名人之后,虚假信息和误导性信息在网络上大量涌现。这些虚假内容,多数已被权威来源揭穿,却重新浮出水面并广泛传播,受到社交媒体和各种 online平台的放大。 为了探究技术在此问题中的作用,Proof News分析了来自行业顶尖公司的AI模型,这些公司致力于遏制选举虚假信息并推动真实内容。不幸的是,结果令人失望:关于哈里斯和特朗普的AI生成回应中,大约有30%包含不准确或误导性信息,可能使读者产生混淆或误导。 这一挑战凸显了AI开发者面临的关键难题,主要是在让AI生成类似人类的文字能力与确保涉及政治敏感话题的事实准确性之间寻求平衡。这些模型严重依赖大量互联网数据,而互联网上的虚假信息普遍存在,且常难以区分于经验证的事实。 此外,政治叙事的动态变化以及哈里斯和特朗普等人物所处的复杂社会背景,也给信息管理带来了难题。被长时间揭穿的虚假谣言常以新形式重新出现,使得AI系统难以始终保持与最新事实核查的一致。 虽然AI公司在应对选举虚假信息方面的承诺值得肯定且至关重要,但此次调查结果也凸显了亟需加强AI训练、优化数据整理以及实现实时事实核查整合的紧迫性。增加对AI生成内容来源的透明度和采取更强有力的安全措施,也能有效减少误导性输出。 专家指出,AI应作为补充而非取代人类判断的工具;用户在面对AI产生的信息时,尤其是在选举等重要公共事务中,仍需保持批判性思维。 总之,哈里斯的历史性提名彰显了美国政治的进步,但也揭示了数字时代信息流动所面临的复杂挑战。AI在塑造公共话语中的作用日益增强,要求我们不断加强警惕和优化,确保这些技术能够维护真相、支持民主进程,而非误导或削弱它们。 随着政治动态的不断演变,AI开发者、政策制定者与公众之间的合作变得尤为重要,以营造一个以准确为主、虚假信息为辅的良性信息环境。通过应对Proof News所揭示的问题,AI将能更好地成为未来公共政治话语中传递清晰与理解的工具。

Watch video about

人工智能模型在关于卡马拉·哈里斯和唐纳德·特朗普的内容中产生了30%的误导性信息,引发选举虚假信息的担忧

Try our premium solution and start getting clients — at no cost to you