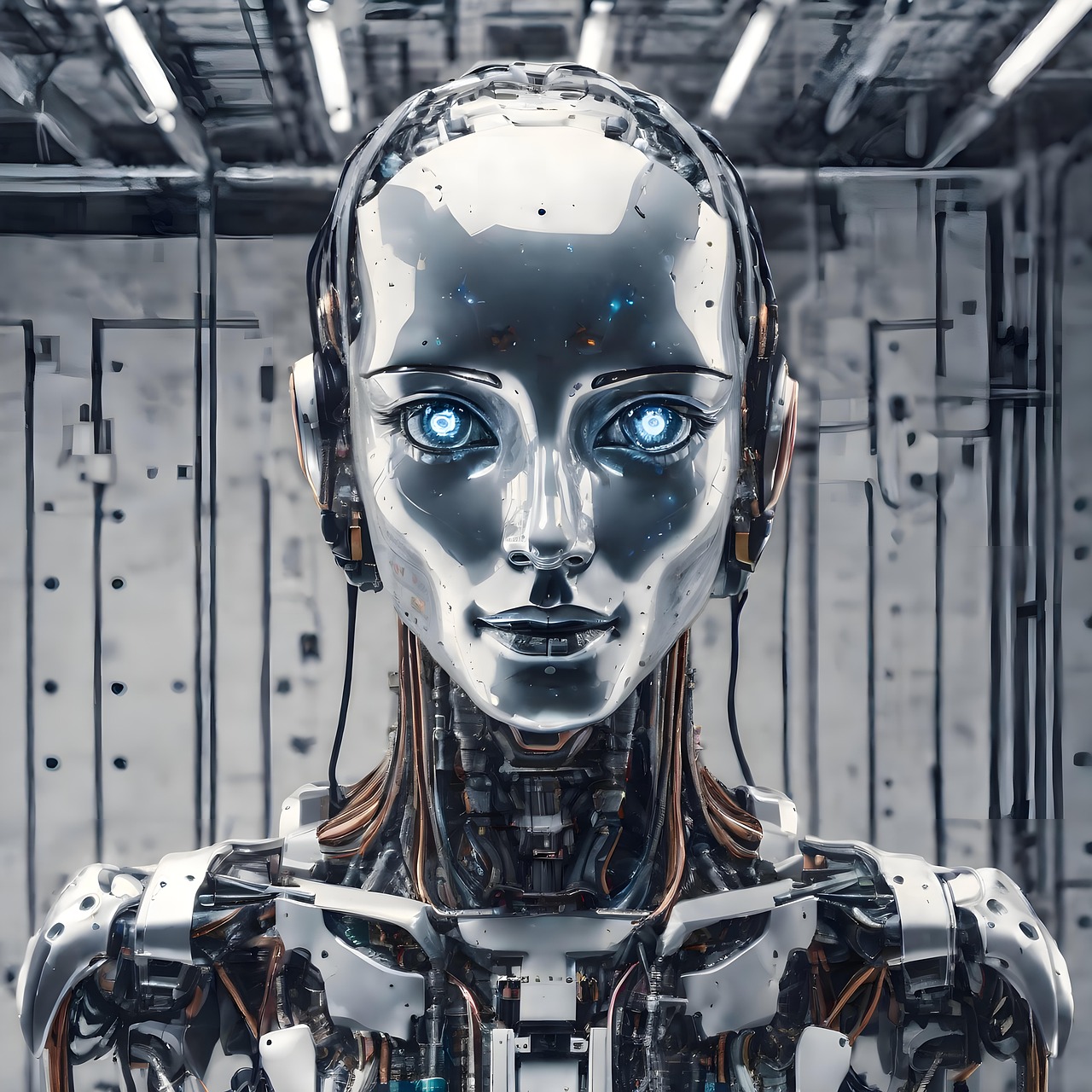

AI-drevet videoinnholdsmoderering: Økt sikkerhet og effektivitet i digital media

Brief news summary

I dagens digitale medielandskap er AI-drevne verktøy avgjørende for å moderere store mengder brukergenerert videoinnhold ved å analysere visuelle, auditive og tekstlige data i sanntid. Disse systemene oppdager skadelig materiale som hatprat, trakassering og grafisk vold for å sikre overholdelse av fellesskapsregler. Automatisering akselererer forhåndsfiltrering og merking, noe som letter den emosjonelle belastningen på menneskelige moderatorer. Utfordringene ligger imidlertid i å moderere innhold nøyaktig på tvers av språk, kulturer og kontekster, siden feil kan skade brukeropplevelse og tillit. For å møte stadig mer kompleks skadelig innhold og håndtere etiske spørsmål som transparens, skjevhet og klageprosesser, bruker plattformer ofte hybride tilnærminger som kombinerer AI med menneskelig vurdering, eksperters innspill og samfunnsfeedback. Selv om AI-drevet moderering forbedrer skalerbarhet og sikkerhet, er det viktig å balansere automatisering med menneskelig overvåkning for å opprettholde rettferdighet, nøyaktighet og skape inkluderende rom som oppmuntrer til ansvarlig, kreativ uttrykk.I det raskt skiftende digitale medielandskapet benytter stadig flere online plattformer kunstig intelligens (AI) for å håndtere og moderere videoinnhold mer effektivt. Med den eksponentielle veksten av brukergenererte videoer har det blitt avgjørende å opprettholde trygge og respektfulle digitale miljøer. For å takle dette bruker mange plattformer nå AI-drevne verktøy for videomoderasjon som raskt oppdager og fjerner skadelig innhold. Disse verktøyene benytter avanserte maskinlæringsalgoritmer for å analysere videoinnsendinger i sanntid ved å undersøke visuelle, auditive og tekstlige elementer. De kan identifisere problematisk innhold som hatytringer, trakassering, grafisk vold og andre brudd på fellesskapsregler, noe som gjør det mulig med raskere reaksjoner sammenlignet med tradisjonell, arbeidsintensiv manuell vurdering. En stor fordel med AI-moderasjon er dens evne til å redusere den tunge byrden for menneskelige moderatorer, som står overfor utfordringer som å behandle store volumer av videoer, håndtere den følelsesmessige belastningen av krevende materiale, og sikre konsistent håndheving av retningslinjer. AI kan forhåndsfiltrere innhold ved å merke potensielt skadelig videomateriale for rask vurdering av mennesker eller, i enkelte tilfeller, automatisk fjerne det basert på forhåndsinnstilte kriterier. Dette øker ikke bare effektiviteten i moderasjonsarbeidet, men gjør det også mulig for menneskelige moderatorer å fokusere på mer komplekse eller grensecase som krever nyanserte vurderinger. Til tross for disse fremskrittene, står flere utfordringer i veien for en bredere bruk av AI i videomoderasjon. En kritisk sak er å sikre nøyaktigheten i AI-deteksjon; mens maskinlæringsmodeller er avhengige av store datamengder, gjør språkets, kulturens og kontekstens subtilitet at det er vanskelig å opprettholde en konsekvent differensiering mellom skadelig og akseptabelt innhold.

Falske positiver, der harmløst innhold feilaktig blir flagget eller fjernet, og falske negativer, hvor skadelig innhold ikke blir oppdaget, truer både brukeropplevelsen og plattformens omdømme. I tillegg krever det kontinuerlig oppdatering og forbedring av moderasjonsverktøy, ettersom ny skadelig innhold samt subtile former for hat eller trakassering ofte oppstår raskere enn AI-modeller kan trenes på nytt. Derfor er en hybrid tilnærming som kombinerer AI med menneskelig ekspertise og tilsyn nødvendig for rettferdig og presis håndheving av innholdspolicyer. Etiske hensyn spiller også en avgjørende rolle i AI-drevet moderasjon. Transparens rundt hvordan beslutninger tas, samt tydelige klageprosesser for fjerning av innhold, er viktige for å opprettholde brukertilliten. Plattformene må også ta tak i potensielle skjevheter i AI-modellene, som kan påvirke visse brukergrupper eller stemmer uforholdsmessig, og dermed risikere sensur eller diskriminering. For å overkomme disse utfordringene tar mange plattformer i bruk hybride moderasjonsstrategier, der AI fungerer som en første-linje filter supplert av dyktige menneskelige moderatorer som vurderer innholdet i kontekst og tar de endelige beslutningene. Samarbeid med eksterne eksperter, interesseorganisasjoner og brukersamfunn bidrar også til å forbedre policyer og teknologier, slik at de bedre kan tjene et mangfold av globale brukere. Oppsummert markerer AI-verktøy for videomoderasjon betydelig fremskritt i håndteringen av den komplekse videoundergruppen på nettet ved å muliggjøre raskere reaksjoner og redusere moderatorenes arbeidsbelastning, og dermed skape tryggere digitale rom. Likevel kreves kontinuerlige innsats for å forbedre presisjonen, redusere feil og opprettholde etiske standarder. En balansegang mellom automatiserte systemer og menneskelig tilsyn vil være avgjørende for å forme fremtidens innholdsmelding, og fremme respektfulle og inkluderende online fellesskap hvor kreativitet og ytringsfrihet kan vokse på en ansvarlig måte.

Watch video about

AI-drevet videoinnholdsmoderering: Økt sikkerhet og effektivitet i digital media

Try our premium solution and start getting clients — at no cost to you