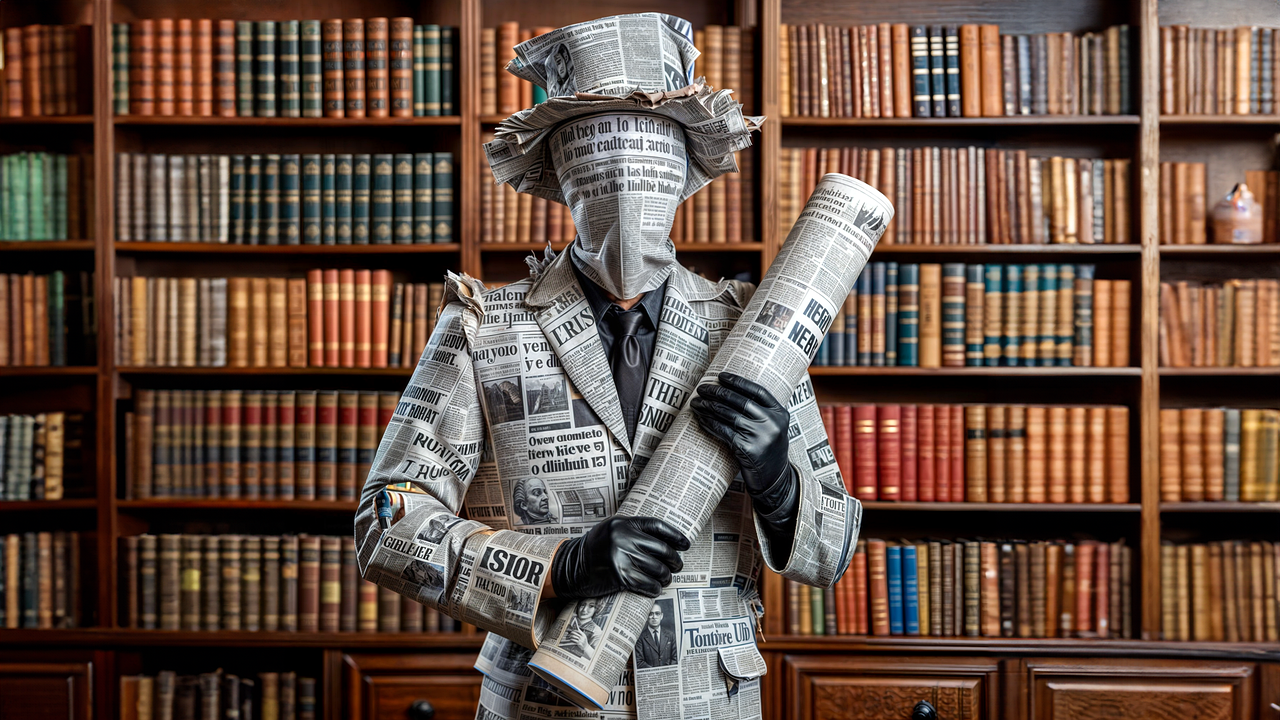

应对人工智能操控不雅家庭照片的伦理与法律挑战

Brief news summary

人工智能(AI)技术正被越来越多地滥用,通过操控家庭照片,制造逼真的但虚假的未成年人不雅图片。虽然这些由AI生成的图片并不反映实际的虐待行为,但它们助长了儿童性虐待材料(CSAM)的传播,并被用来进行骚扰、胁迫和勒索,造成严重的情感伤害。执法部门在侦查和起诉这些案件时面临挑战,因为这些图片非常逼真,加上现有法律框架没有专门针对由AI生成内容的漏洞。作为应对,科技公司和网络安全专家正在研发先进的检测工具,以应对这一新兴威胁。提高公众意识、倡导审慎分享照片线上内容是关键的预防措施。在数字时代保护儿童权益,需要相关部门、法律体系、科技公司和家庭共同协作,有效应对并预防由AI驱动的网络剥削。人工智能技术,尽管在各个领域带来了许多进步和利益,但近年来也被以一种令人担忧的方式加以利用,引发了重大伦理和法律问题。其中一个特别令人不安的问题是利用人工智能操纵家庭照片,将其变成不雅照片。这种滥用行为正在成为全球执法机构和儿童保护倡导者日益关注的问题。基于人工智能的图像操控现在可以将原本用于记录幸福而私密瞬间的普通家庭照片篡改成不当和有害的内容,且未获得被拍摄者的同意或知情。这些被操控的图像看起来令人震惊地逼真,使得侦测和追究责任变得格外困难。 执法人员在应对这一令人担忧的趋势上处于前线。人工智能算法的高精度使得恶意行为者能够创建或修改涉及未成年人的不雅图像,增加了调查难度,也阻碍了正义的实现。这些伪造的图像可以在网络上被广泛传播,助长儿童性剥削材料(CSAM)传播的更广泛问题。传统上,打击CSAM的努力主要集中在识别和删除由真实虐待产生的照片和视频。而由AI生成的虚假图像则增加了新的复杂性——它们不是真实虐待的表现,但却可能被滥用进行骚扰、胁迫或勒索,对受害者造成严重的情感伤害。 此外,AI篡改的不雅图片也对现行法律体系带来了挑战。检察官和立法者在界定和分类这些由AI生成的视觉内容时遇到困难——难以将它们与真正的儿童剥削内容区分开来,也难以确定适当的惩罚和预防措施。这种法律上的模糊性有时会延缓对犯罪者的有效打击。 科技公司和网络安全专家正在积极研发先进的检测工具,以快速、准确地识别被AI操控的图像,意在遏制它们在社交媒体和暗网上的传播。然而,随着AI技术的迅速发展,检测方法也必须不断调整以保持其有效性。 公共意识宣传在这方面也起着至关重要的作用。教育家庭了解潜在的风险,倡导在分享照片时保持谨慎,可以帮助减少曝光于此类利用。特别是父母和监护人应谨慎在公共或不安全的平台上发布家庭照片,尤其是含有未成年人的照片。 总之,虽然人工智能持续改变着人们的日常生活的许多方面,但其在篡改家庭照片的不雅内容中的滥用带来了严重挑战,亟需协调行动。执法部门、法律体系、技术公司和公众必须携手合作,制定有效策略来应对这一新兴的网络儿童性剥削形式。通过加强技术防范、强化法律措施和提高公众意识,社会可以更有力地保护儿童的权益和尊严,迎接数字时代的挑战。

Watch video about

应对人工智能操控不雅家庭照片的伦理与法律挑战

Try our premium solution and start getting clients — at no cost to you