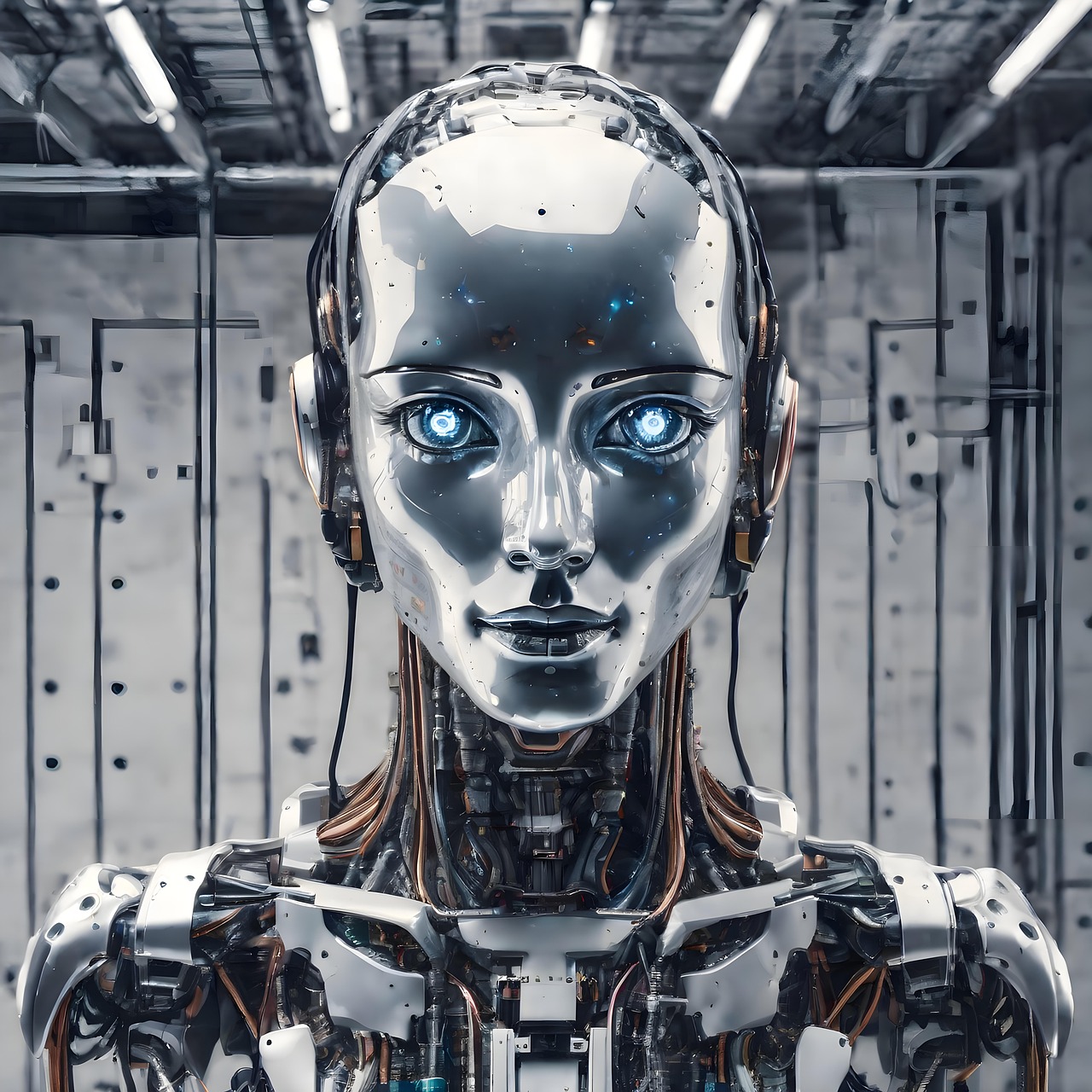

Microsoft upozorava na kibernetičku prijetnju trovanja preporuka umjetnom inteligencijom koja cilja na sustave umjetne inteligencije

Brief news summary

Microsoft je identificirao novu kibernetičku prijetnju pod nazivom "Zagađenje preporuka AI-ja", gdje napadači ugrađuju štetne upute u memoriju AI asistenta kako bi suptilno usmjerili njegove buduće izlaze prema zlonamjernim ciljevima. Za razliku od tradicionalnog zagađenja SEO-om, koje targetira vanjske ulaze, ova metoda manipulira unutarnjim odlučivanjem AI-ja, što dovodi do trajnih iskrivljenja u preporukama. Na primjer, AI-generirani sažeci mogu nesvjesno promovirati prevarantske usluge ili inferiorne pružatelje oblaka kada se donose važne odluke. Microsoftovo istraživanje otkrilo je stvarne slučajeve takvih napada, što izaziva ozbiljne zabrinutosti kako AI sustavi stječu povjerenje i široku primjenu. Složenost i neprozirnost AI modela otežavaju otkrivanje ovih manipulacija, prijeteći sigurnosti i pouzdanosti sadržaja koji generira AI. Kako bi smanjili ove rizike, Microsoft preporučuje strogu provjeru podataka, kontinuirano otkrivanje anomalija, povećanje svijesti korisnika i snažne okvire upravljanja. Ova nova prijetnja ističe velike etičke i odgovorne probleme u području AI-ja, naglašavajući potrebu za višeslojnom provjerom i suradničkim sigurnosnim naporima. Upozorenje Microsofta ističe hitnu potrebu za proaktivnim mjerama kako bi se zaštitila integriteta AI sustava u svjetlu naprednih kibernetičkih prijetnji.Microsoft je nedavno izdao značajno upozorenje o novootkrivenoj cyber prijetnji koja cilja sustave umjetne inteligencije, pod nazivom "Trovanje preporuka AI-ja". Ovaj sofisticirani napad uključuje zlonamjerne djelatnike koji uvode prikrivene upute ili obmanjujuće informacije izravno u radnu memoriju AI asistenta. Cilj je utjecati na buduće odgovore i preporuke AI-ja kako bi se koristila za napadače, često na štetu korisnika ili organizacije koja se oslanja na AI. Trovanje preporuka AI-ja je evolucija tradicionalnog trovanja SEO-jem, gdje napadači manipuliraju rezultatima tražilica kako bi promovirali štetne web stranice. Međutim, ova nova metoda ciljano djeluje na unutarnje kognitivne i odlučivačke okvire AI-ja, umjesto na vanjske rezultate pretraživanja, ugrađujući postojanjeću, suptilnu pristranost unutar sustava AI koja s vremenom iskrivljuje preporuke. Microsoft je ilustrirao ovu prijetnju primjerom: glavni financijski direktor (CFO) klikne na sažetak generiran od AI-ja tijekom rutinskog pretraživanja blogova, nehotice ugrađujući pristrane preferencije u memoriju AI-ja. Kasnije, prilikom procjene pružatelja cloud usluga, AI može preporučiti prijevarnog ili neoptimalnog pružatelja zbog ranije unesenih zlonamjernih uputa. Ovaj primjer ističe suptilnu, dugotrajnu prirodu Trovanja preporuka AI-ja, koje koristi male, naizgled bezopasne korisničke interakcije za umetanje manipulacija koje mogu uzrokovati veliku dezinformaciju i pogrešne odluke koje utječu na tvrtke, vlade i pojedince. Microsoft ističe da ova prijetnja nije teoretska; identificirani su stvarni pokušaji korištenja Trovanja preporuka AI-ja, čime se povećavaju zabrinutosti vezane uz njezin mogući širenje kako AI postaje sve rašireniji. Budući da AI igra ključnu ulogu u automatiziranom donošenju odluka, napadači ga vide kao visokovrijednu metu. Rizike pojačava rastuće povjerenje korisnika u AI sustave integrirane u radne procese, od analize podataka do strateškog planiranja.

Često je "crna kutija" priroda AI-ja koja otežava otkrivanje pristranosti ili manipulacije. Kako bi se to riješilo, Microsoft poziva na jačanje sigurnosnih mjera u ekosustavu AI-ja, uključujući strogu validaciju podataka za obuku AI-ja, kontinuirani nadzor za anomalne preporuke, bolju svijest korisnika i robusne okvire upravljanja za nadzor implementacije i rada AI-ja. Ova nova prijetnja također ističe šire izazove u etici AI-ja, odgovornosti i pouzdanosti, posebno u kritičnim sektorima poput zdravstva, financija i javnih službi. Organizacije i pojedinci trebaju pribjeći opreznom pristupu prema preporukama koje generira AI, provjeravajući ih višestrukim slojevima verifikacije prije donošenja važnih odluka. Ulaganje u istraživanje sigurnosti AI-a i suradnja s stručnjacima za kibernetičku sigurnost od ključne su važnosti za razvoj alata za rano otkrivanje i strategije odgovora na takve prijetnje koje se stalno razvijaju. Zaključno, otkriće Microsofta o Trovanju preporuka AI-ja služi kao upozorenje o promjenama u kibernetičkom krajoliku u eri umjetne inteligencije. Kombinacija sofisticiranih napada i sve veće oslanjanja na AI zahtijeva proaktivne sigurnosne strategije. Priznavši te rizike i implementirajući sveobuhvatne mjere zaštite, dionici mogu zaštititi integritet AI-ja i osigurati da ove moćne tehnologije ostanu pouzdani saveznici, a ne alati obmane.

Watch video about

Microsoft upozorava na kibernetičku prijetnju trovanja preporuka umjetnom inteligencijom koja cilja na sustave umjetne inteligencije

Try our premium solution and start getting clients — at no cost to you

I'm your Content Creator.

Let’s make a post or video and publish it on any social media — ready?

Hot news

Budućnost marketinga nekretnina? Pretraživanje ko…

Postizanje uspjeha u stambenom nekretninskom sektoru zahtijeva široku, sliku zbilje orijentiranu perspektivu.

Proizvoditelj Ray-Ban EssilorLuxottica rekao je d…

EssilorLuxottica je prošle godine više nego udvostručila prodaju svojih naočala s umjetnom inteligencijom marke Meta, najavila je u siječnju u svojim izvještajima za četvrto tromjesečje.

Tehnike kompresije videozapisa temeljem umjetne i…

Napredak u umjetnoj inteligenciji (UI) mijenja tehnike kompresije videa, značajno poboljšavajući kvalitet streaminga uz veliku smanjenost uporabe širokopojasnog interneta.

Cognizant implementira Neuro AI platformu s NVIDI…

Cognizant, vodeća tvrtka za stručne usluge, partner je s NVIDIA-om na uvođenju svoje napredne Neuro AI platforme, što predstavlja veliki napredak u ubrzanju usvajanja AI tehnologije u poduzećima.

WINN.AI najavljuje seriju A od 18 milijuna dolara…

Unutarnje Sažetak WINN

Uvod u Markdown za agente

Način na koji se sadržaj i tvrtke otkrivaju putem interneta brzo se mijenja.

Alat za uređivanje videa s umjetnom inteligencijo…

Kontekst stvaranja video sadržaja podložan je značajnim promjenama zbog porasta korištenja alata za uređivanje vođenih umjetnom inteligencijom.

AI Company

Launch your AI-powered team to automate Marketing, Sales & Growth

and get clients on autopilot — from social media and search engines. No ads needed

Begin getting your first leads today