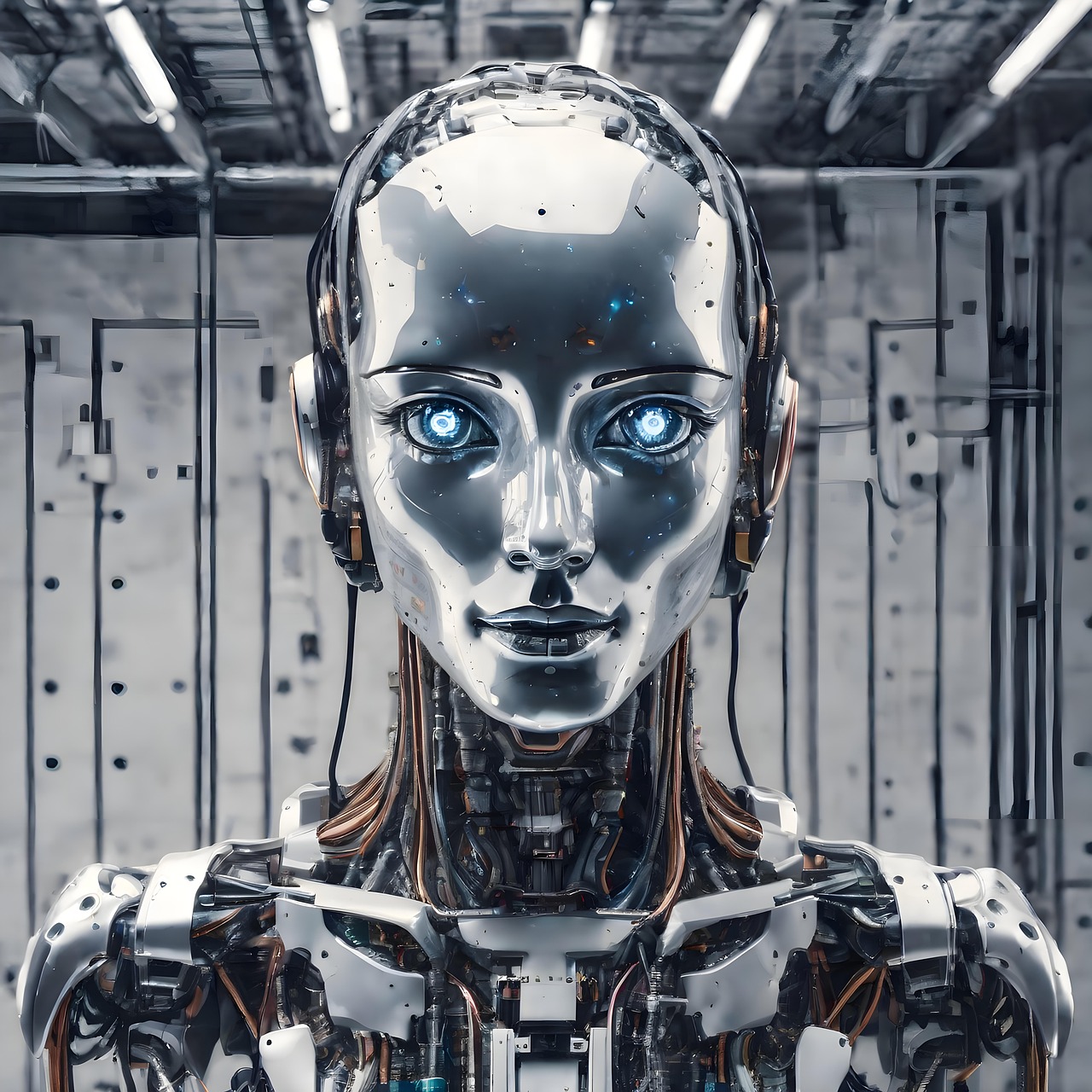

Microsoft advarer om giftig AI-anbefalingsangrep som retter seg mot AI-systemer

Brief news summary

Microsoft har identifisert en ny cybertrussel kalt "AI Anbefalings-Poisoning", hvor angripere innbaker skadelige instruksjoner i AI-assistenters minne for subtilt å bruke deres fremtidige output i en ondsinnet retning. I motsetning til tradisjonell SEO-forgiftning, som retter seg mot eksterne innspill, manipulerer denne metoden AI sitt interne beslutningsprosesser, noe som fører til vedvarende forvrengninger i anbefalinger. For eksempel kan AI-genererte oppsummeringer uten å vite det promotere svindelaktiviteter eller mindre pålitelige skytjenesteleverandører når viktige beslutninger tas. Microsofts forskning har avdekket faktiske tilfeller av slike angrep, noe som gir alvorlige bekymringer etter hvert som AI-systemer får større tillit og brukes i bred skala. Kompleksiteten og den uklare strukturen til AI-modeller gjør det utfordrende å oppdage disse manipulasjonene, og truer sikkerheten og påliteligheten til AI-generert innhold. For å redusere disse risikoene anbefaler Microsoft streng datavalidering, kontinuerlig deteksjon av unormale aktiviteter, økt brukerbevissthet og robuste styringsrammer. Denne nye trusselen avdekker viktige etiske og ansvarsrelaterte problemstillinger innen AI, og understreker behovet for lagvise verifiseringsprosesser og samarbeid om sikkerhet. Microsofts advarsel fremhever det presserende behovet for proaktive tiltak for å beskytte AI-integriteten i møte med økende cyberrisikoer.Microsoft har nylig utstedt en betydelig advarsel om en nylig identifisert cybertrussel som retter seg mot kunstig intelligens-systemer, kalt "AI-anbefalingsforgiftning". Dette avanserte angrepet innebærer at skadelige aktører injiserer skjulte instrukser eller villedende informasjon direkte inn i en AI-assistents operative minne. Formålet er å påvirke AI-ens fremtidige svar og anbefalinger for å gagne angriperne, ofte på bekostning av brukeren eller organisasjonen som er avhengig av AI-en. AI-anbefalingsforgiftning er en utvikling av tradisjonell SEO-forgiftning, hvor angripere manipulerer søkeresultater for å fremme skadelige nettsteder. Denne nye metoden retter seg imidlertid mot AI-ens interne kognisjon og beslutningsrammer i stedet for eksterne søkeresultater, og injiserer varige, subtile skjevheter i AI-systemene som over tid påvirker anbefalingene. Microsoft illustrerte denne trusselen med et eksempel: en finansdirektør (CFO) klikker på en AI-generert oppsummering i et rutinemessig blogginnlegg, uten å vite at det er med på å integrere skjeve preferanser i AI-ens minne. Senere, når vedkommende vurderer skytjenesteleverandører, kan AI-en anbefale en svindelaktør eller en suboptimal leverandør på grunn av disse tidligere injiserte skadelige instruksene. Dette eksempelet fremhever den subtile, langvarige naturen til AI-anbefalingsforgiftning, som bruker små, tilsynelatende harmløse brukerinteraksjoner til å plante manipulasjoner som kan føre til betydelig feilinformasjon og feilaktige beslutninger som påvirker bedrifter, myndigheter og enkeltpersoner. Microsoft understreker at denne trusselen ikke er teoretisk; faktiske forsøk på å bruke AI-anbefalingsforgiftning er blitt identifisert, noe som øker bekymringen for at den kan spre seg etter hvert som AI blir mer utbredt. Siden AI spiller en transformativ rolle i automatiserte beslutningsprosesser, ser angripere på den som et høyt verdsatt mål. Risikoen forsterkes av brukeres økende tillit til AI-systemer som er integrert i arbeidsflyter for oppgaver som datanalyse og strategisk planlegging.

AI sin ofte lukket "black box"-natur gjør det vanskelig å oppdage skjevheter eller manipulasjoner. For å håndtere dette, etterlyser Microsoft sterkere sikkerhetstiltak i AI-økosystemet, inkludert grundig validering av treningsdata, kontinuerlig overvåking etter anomalier i anbefalingene, bedre brukerbevissthet og robuste styringsrammer for å overvåke AI-implementering og drift. Denne nye trusselen belyser også bredere utfordringer innen etikk, ansvarlighet og pålitelighet i AI, spesielt i kritiske sektorer som helsevesen, finans og offentlige tjenester. Organisasjoner og enkeltpersoner bør ta en forsiktig tilnærming til AI-genererte anbefalinger, og bruke lagdelte verifiseringsmetoder før viktige beslutninger fattes. Det er avgjørende å investere i AI-sikkerhetsforskning og samarbeide med cybersikkerhetseksperter for å utvikle tidlige varslingsverktøy og handlingsplaner mot slike stadig mer avanserte trusler. Avslutningsvis fungerer Microsofts avsløring av AI-anbefalingsforgiftning som et varsel om de endrede cybertrusselbildene i AI-alderen. Kombinationen av sofistikerte angrep og økt avhengighet av AI krever proaktive sikkerhetsstrategier. Ved å erkjenne disse risikoene og implementere omfattende beskyttelsestiltak, kan interessenter beskytte AI-ens integritet og sikre at disse kraftfulle teknologiene forblir pålitelige allierte i stedet for verktøy for svindel.

Watch video about

Microsoft advarer om giftig AI-anbefalingsangrep som retter seg mot AI-systemer

Try our premium solution and start getting clients — at no cost to you

I'm your Content Creator.

Let’s make a post or video and publish it on any social media — ready?

Hot news

Fremtiden for eiendomsannonsering? Det er AI-drev…

Oppnå suksess i boligreale estate krever et bredt, helhetlig perspektiv.

Ray-Ban-produsenten EssilorLuxottica sier at de m…

EssilorLuxottica tredoblet salget av Meta sine kunstig intelligens-briller i fjor, kunngjorde Ray-Ban-produsenten onsdag i sine resultater for fjerde kvartal.

AI-videokomprimeringsteknikker forbedrer strømmek…

Fremgangen innen kunstig intelligens (AI) transformerer videokomprimeringsteknikker, noe som betydelig forbedrer strømmetjenestens kvalitet samtidig som båndbreddeforbruket reduseres kraftig.

WINN.AI kunngjør en serie A-investering på 18 mil…

Insider-Melding WINN

Å introdusere Markdown for agenter

Måten innhold og bedrifter oppdages på nettet på, utvikler seg raskt.

AI-drevne videoredigeringsverktøy revolusjonerer …

Landskapet for videoinnholdproduksjon gjennomgår en betydelig transformasjon på grunn av økningen av AI-drevne redigeringsverktøy.

Dappiers interaktive annonser forbedrer utgiveres…

I oktober 2025 kunngjorde Dappier, et ledende teknologiselskap som spesialiserer seg på AI-drevne annonseløsninger, et strategisk partnerskap med LiveRamp, en fremtredende plattform for datatilkobling.

AI Company

Launch your AI-powered team to automate Marketing, Sales & Growth

and get clients on autopilot — from social media and search engines. No ads needed

Begin getting your first leads today