"Chip Fotônico Inovador Aprimora o Desempenho de Redes Neurais Profundas"

Brief news summary

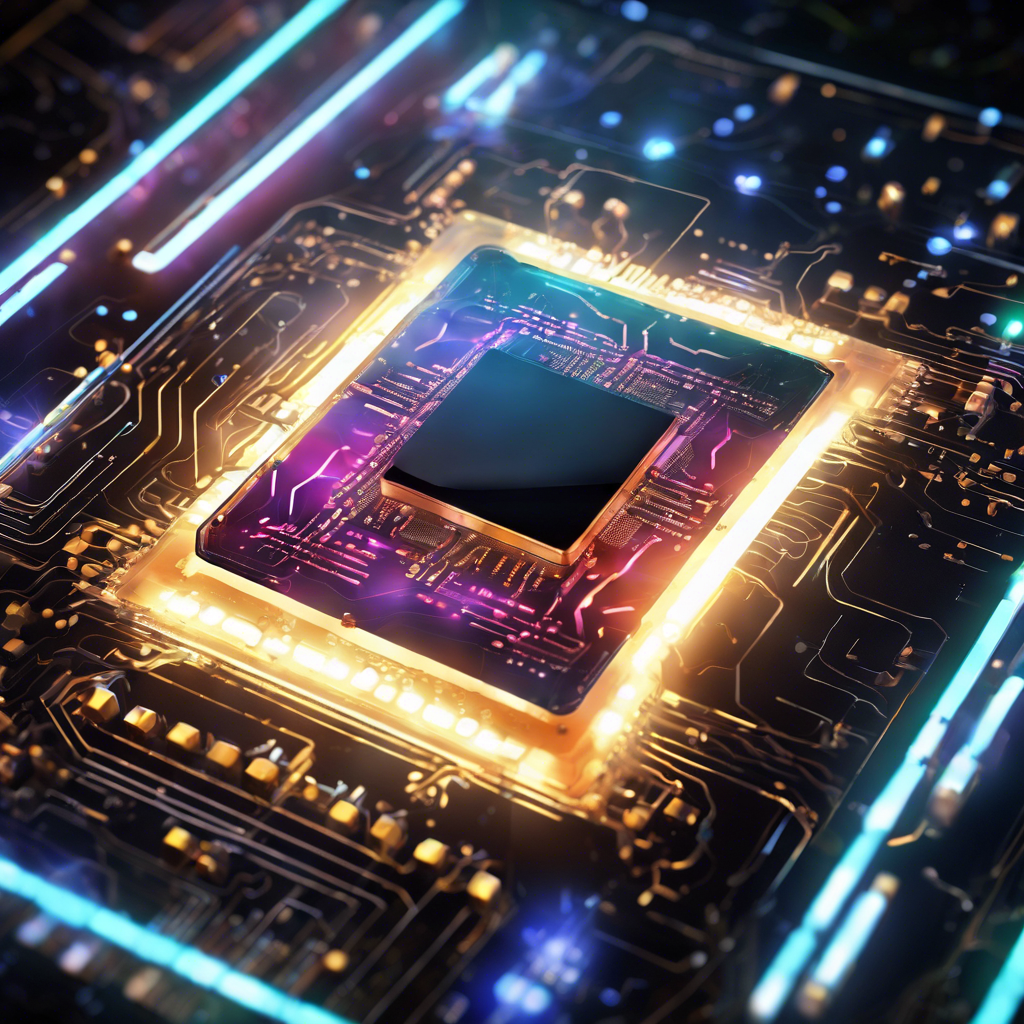

Cientistas do MIT e colaboradores desenvolveram um chip fotônico revolucionário que aprimora os cálculos de redes neurais profundas usando métodos ópticos, superando limitações anteriores. Este chip avançado pode realizar tarefas de aprendizado de máquina em menos de meio nanossegundo com mais de 92% de precisão, desafiando o hardware eletrônico tradicional. Fabricado com técnicas comerciais, incorpora módulos interconectados para formar uma rede neural óptica, permitindo escalabilidade e fácil integração com sistemas eletrônicos. Esta inovação promete aplicações de aprendizado profundo mais rápidas e eficientes em termos de energia em áreas como lidar, pesquisa científica e telecomunicações. O chip utiliza unidades de função óptica não linear (NOFUs) para operações não lineares, reduzindo significativamente o consumo de energia. Após o treinamento, alcançou mais de 96% de precisão com métodos semelhantes à tecnologia CMOS, demonstrando seu potencial para produção em massa. A equipe de pesquisa planeja aprimorar ainda mais as capacidades do chip e explorar novos algoritmos para maximizar as vantagens da computação óptica. Este projeto inovador recebeu financiamento da Fundação Nacional de Ciência dos EUA, do Escritório de Pesquisa Científica da Força Aérea dos EUA e da NTT Research.Os modelos de redes neurais profundas tornaram-se tão grandes e complexos que desafiam as capacidades do hardware de computação eletrônica tradicional. O hardware fotônico, que processa cálculos usando luz, oferece uma alternativa mais rápida e eficiente em termos de energia, mas tem lutado com certos cálculos de redes neurais devido a limitações que atrasam o desempenho. Pesquisadores do MIT e de outras instituições desenvolveram um novo chip fotônico que resolve essas questões. Este processador fotônico totalmente integrado pode realizar todas as operações fundamentais de redes neurais profundas opticamente no chip. O chip completou cálculos para uma tarefa de classificação de aprendizado de máquina em menos de meio nanossegundo com 92% de precisão, comparável ao hardware tradicional. Construído usando processos de fundição comercial, o chip apresenta módulos interligados que formam uma rede neural óptica, sinalizando futuras aplicações eletrônicas escaláveis e integráveis. Este avanço pode melhorar a velocidade e eficiência energética do aprendizado profundo, beneficiando áreas como lidar, astronomia, física de partículas e telecomunicações. O sistema permite operações completas de redes neurais em óptica na escala de nanossegundos, tornando-se significativamente mais rápido. O pesquisador principal Saumil Bandyopadhyay destacou a importância da velocidade e eficiência no desempenho dos modelos e o potencial para aplicações inovadoras e algoritmos. A equipe de pesquisa inclui ex-alunos e professores do MIT, como Alexander Sludds, Nicholas Harris, Darius Bunandar e Dirk Englund, com o estudo publicado na Nature Photonics. Redes neurais ópticas envolvem camadas de nós interconectados realizando álgebra linear, como multiplicação de matrizes, essencial para a transformação de dados. Operações não lineares como funções de ativação permitem que as redes aprendam padrões complexos.

Em 2017, um único chip fotônico foi desenvolvido para multiplicação de matrizes, mas operações não lineares exigiam converter dados ópticos em sinais elétricos, consumindo muita energia. Para superar isso, os pesquisadores projetaram unidades de função óptica não linear (NOFUs) que integram eletrônicos e óptica para operações não lineares no chip. Sua rede neural óptica é composta por três camadas de dispositivos para funções lineares e não lineares. O novo sistema codifica parâmetros de rede neural em luz, com divisores de feixe programáveis lidando com a multiplicação de matrizes. As operações não lineares são realizadas por NOFUs, que utilizam fotodiodos para converter sinais ópticos em corrente elétrica de maneira eficiente. Este processamento no domínio óptico reduz drasticamente a latência e o consumo de energia. Alcançando baixa latência, o sistema treina redes neurais profundas eficientemente no chip, conhecido como treinamento in situ, que geralmente requer muita energia em hardware digital. O processador fotônico alcançou mais de 96% de precisão no treinamento e mais de 92% na inferência, realizando cálculos em menos de meio nanossegundo. O circuito foi fabricado com os mesmos processos que criam chips CMOS, permitindo potencial produção em massa com erro mínimo. O trabalho futuro se concentrará em integrar o dispositivo com eletrônicos do mundo real e desenvolver algoritmos que aproveitem as vantagens ópticas para um treinamento mais rápido e eficiente em termos de energia. Esta pesquisa recebeu apoio da National Science Foundation dos EUA, do Air Force Office of Scientific Research dos EUA e da NTT Research.

Watch video about

"Chip Fotônico Inovador Aprimora o Desempenho de Redes Neurais Profundas"

Try our premium solution and start getting clients — at no cost to you