Exploration de l'IA générative à travers les chaînes de Markov

Brief news summary

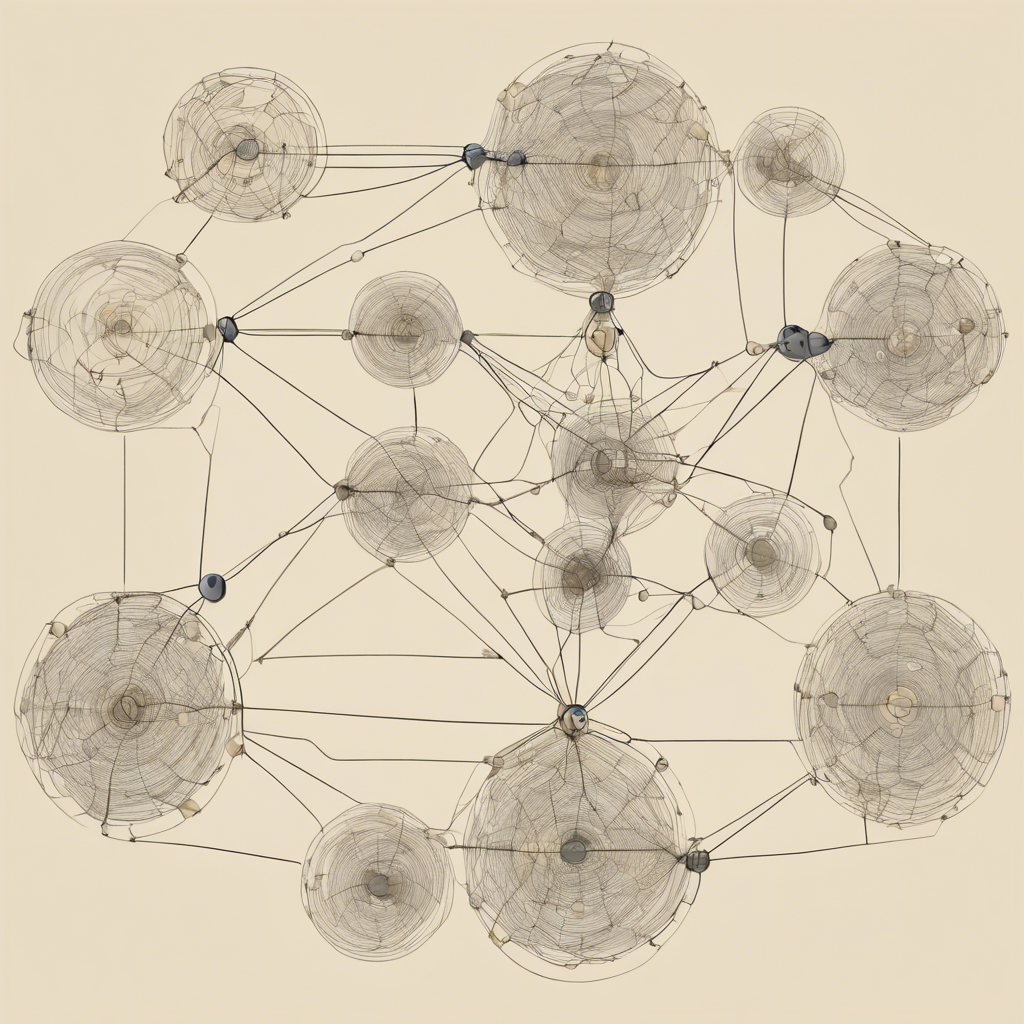

Les chaînes de Markov offrent un cadre simplifié pour comprendre l'IA générative et les grands modèles de langage (LLM) en se concentrant sur les transitions d'état basées sur des probabilités. Cette approche est éclairante pour analyser comment des modèles comme GPT imitent le langage humain en identifiant et utilisant des motifs dans de vastes ensembles de données. Bien que les LLM soient complexes, les chaînes de Markov aident à approximer leur comportement, notamment sous des contraintes comme la taille du vocabulaire, offrant des perspectives sur l'évolutivité et l'adaptabilité. Malgré les débats sur leurs limites à capturer pleinement les complexités des LLM modernes, l'étude des chaînes de Markov reste bénéfique pour améliorer notre compréhension de la génération de langage et aider à prévoir et interpréter les sorties des modèles. Des recherches continues sont essentielles pour évaluer la praticité des chaînes de Markov dans l'analyse de l'IA, à mesure que la technologie évolue. Explorer ces systèmes sous divers angles est crucial pour faire progresser les connaissances théoriques et garantir des applications pratiques efficaces.Dans la chronique d'aujourd'hui, j'explore une approche novatrice pour démêler les complexités de l'IA générative et des modèles de langage avancés (LLM) en utilisant le concept mathématique des chaînes de Markov. Pour ceux qui ne sont pas familiers, les chaînes de Markov sont une méthode apprise dans les cours de statistique, et elles peuvent fournir des éclairages sur les processus d'IA et de LLM. Les chaînes de Markov modélisent les processus comme une série d'états ou d'étapes, passant d'un état à un autre en fonction de probabilités. Par exemple, envisagez une visite au DMV : vous passez de la fenêtre d'enregistrement à une fenêtre de traitement ou de finalisation en fonction des probabilités du processus administratif nécessaire. De même, les chaînes de Markov impliquent des états et des transitions basées sur des probabilités statistiques, comme l'a d'abord conceptualisé le mathématicien russe Andrey Markov en 1913 en analysant des séquences de lettres dans des textes littéraires. L'IA générative, comme ChatGPT et d'autres LLM, fonctionne sur des transitions basées sur l'état similaires en transformant du contenu écrit en points de données tokenisés et en prédisant le prochain token possible basé sur des probabilités.

Alors que les chercheurs s'efforcent de comprendre ces processus d'IA, l'application des chaînes de Markov pourrait révéler davantage sur les comportements apparemment mystérieux de l'IA. Des études récentes explorent la possibilité de considérer les LLM comme des chaînes de Markov, suggérant des transitions structurées entre états et calculant des prédictions à partir de vocabulaires limités et de fenêtres contextuelles. Certains professionnels de l'industrie débattent de savoir si les chaînes de Markov peuvent complètement dévoiler les complexités de l'IA, mais les premiers indices montrent que ces modèles pourraient approximer les opérations de tokens d'IA sous certaines contraintes. Malgré des limitations, notamment concernant le focus traditionnel des chaînes de Markov sur les états actuels sans tenir compte des états précédents, les chercheurs repoussent les limites en examinant leur applicabilité à l'IA générative. Des études en cours visent à éclairer les capacités avancées de l'IA à travers les concepts de Markov, signifiant un potentiel mais pas encore des aperçus définitifs des opérations de l'IA. Le paysage de la recherche en évolution continue de remettre en question et affiner notre compréhension de l'IA générative à travers des cadres mathématiques classiques comme les chaînes de Markov, promettant une découverte continue des capacités de l'IA et de sa mécanique interne.

Watch video about

Exploration de l'IA générative à travers les chaînes de Markov

Try our premium solution and start getting clients — at no cost to you