Google Veo 3: Eina avançada d'intel·ligència artificial per a deepfake en vídeos genera preocupacions ètiques i de seguretat

Google ha llançat recentment Veo 3, una eina avançada d’IA per a la generació de vídeos capaç de produir deepfakes altament realistes. Aquesta innovació ha despertat preocupacions importants entre experts, periodistes i el públic perquè pot fabricar vídeos molt autèntics que mostren esdeveniments falsos, com riots violents i fraus electorals, cosa que podria induir a confusió els espectadors i incitar a la inestabilitat social. Un informe d’investigació de la revista TIME va destacar la capacitat de Veo 3 per crear clips convincents de situacions polítiques sensibles que corren el risc de distorsionar la percepció pública. Veo 3 utilitza algoritmes complexos d’IA per oferir no només realisme visual sinó també àudio sincronitzat i moviments realistes, fent que els deepfakes siguin gairebé indistinguibles de la realitat per a la majoria d’ells. Aquesta sofisticació complica les tasques de verificació de fets i amenaça la confiança pública en els mitjans i fonts d’informació oficials i autèntics. En resposta a les preocupacions pel mal ús, Google ha incorporat mesures de seguretat a Veo 3, com filtres que bloquegen sol·licituds relacionades amb la violència explícita, marques d’aigua invisibles en els vídeos generats i—després de crítiques— marques d’aigua visibles. Tot i això, els experts argumenten que aquestes proteccions són insuficients: les marques invisibles requereixen eines de detecció especialitzades, i les visibles poden ser fàcilment tretes per usuaris amb habilitats mínimes, deixant importants forats de seguretat i oportunitats per a l’explotació maliciosa. El potencial malintencionat de Veo 3 i tecnologies similars de síntesi de vídeo amb IA planteja desafiaments legals, ètics i socials profunds. Els experts alerten que, sense regulació, aquestes eines podrien ser utilitzades com a armes per amplificar la propaganda política, aprofundir la polarització i minar els processos democràtics—especialment en moments crítics com les eleccions o els disturbis civils, quan vídeos fabricats podrien prendre’s com esdeveniments reals. Aquest mal ús corre el risc d’incitar a la violència, expanding el pànic i erosionar la confiança en els mitjans legítims, tot confonent fet i ficció. Les plataformes de les xarxes socials, on aquest contingut podria difondre’s ràpidament, es converteixen en focus de xarxes de desinformació. Els usuaris podrien compartir involuntàriament vídeos falsificats o ignorar clips reals com a falsos, a causa del scepticisme generalitzat alimentat per la prevalença de mitjans sintètics.

Aquesta dinàmica paralitza el diàleg públic significatiu i dificulten que la societat pugui abordar amb eficàcia qüestions reals. Davant aquests perills, responsables polítics, tecnòlegs i grups de la societat civil reclamen cada vegada més regulacions més estrictes i mesures de seguretat reforçades per governar els mitjans generats per IA. Les mesures proposades inclouen procediments rigorosos de verificació, etiquetatge obligatori de contingut sintètic i un desenvolupament més ampli de tecnologies de detecció de deepfakes. A més, s’ha posat èmfasi a promoure la consciència pública i l’educació mediàtica per ajudar les persones a distingir millor la informació creïble en un paisatge digital complex. Veo 3 de Google suposa un assoliment important en la creació de mitjans impulsada per IA, demostrant both enorme potencialitats i riscos seriosos. Tot i que la innovació en IA ofereix beneficis com a nova expressió creativa i millor comunicació, els desafiaments que plantegen els deepfakes hiper-realistes requereixen solucions proactives. És fonamental un desplegament responsable per protegir els valors democràtics, mantenir la cohesió social i protegir les persones de la manipulació. A mesura que aquest debat evoluciona, la col·laboració entre empreses tecnològiques, governs, investigadors i la societat és essencial per afrontar les complexitats ètiques i pràctiques dels mitjans sintètics. La manca d’acció pot desestabilitzar societats i erosionar la confiança en institucions claus. És crucial trobar un equilibri entre el progrés tecnològic i els marcs ètics sòlids per aprofitar els avantatges de la IA i minimitzar les seves amenaces, preservant així la integritat de la informació en l’era digital actual.

Brief news summary

Google ha llançat Veo 3, una eina avançada de generació de vídeos amb IA que produeix deepfakes altament realistes, capaços de simular esdeveniments com violentes disturbis i frau electoral. Utilitzant algoritmes sofisticats, Veo 3 alinea imatges, àudio i moviments per crear contingut gairebé indistinguible de material genuí. Tot i incloure mesures de seguretat com filtres de contingut violent i marques d’aigua, aquestes mesures poden ser esquivades,omitint un risc important de mal ús. Aquesta tecnologia planteja greus preocupacions ètiques, legals i socials, especialment durant les eleccions i crisis, quan la informació falsa pot propagar-se ràpidament a les xarxes socials, minant el periodisme i la confiança pública. El llançament de Veo 3 intensifica les demandes de regulacions més estrictes, millores en els mètodes de detecció, etiquetatge obligatori i augment de la alfabetització mediàtica. Destaca l’impacte doble de la IA en els mitjans i subratlla la necessitat urgent de pràctiques responsables i de la col·laboració entre governs, empreses tecnològiques i la societat per preservar els valors democràtics i mantenir la confiança en la informació.

AI-powered Lead Generation in Social Media

and Search Engines

Let AI take control and automatically generate leads for you!

I'm your Content Manager, ready to handle your first test assignment

Learn how AI can help your business.

Let’s talk!

Ciutats intel·ligents impulsades per IA: un nou e…

La intel·ligència artificial (IA) s’està convertint ràpidament en una força transformadora en el desenvolupament de ciutats intel·ligents, segons un estudi recent que analitza les tendències actuals de la IA i les aplicacions urbanes.

Cimer de Finances Inaugural de Londres Blockchain…

Conferència Blockchain de Londres 4 de juny de 2025, 13:29 ET Figures de l’indústria exploren l’impacte transformador de la blockchain en les finances LONDRES, 4 de juny de 2025 /PRNewswire/ — La sèrie d’esdeveniments Blockchain de Londres ha organitzat amb èxit la seva primera Cimer de Finances el 3 de juny, reunint líders globals, innovadors i responsables clau on la tecnologia blockchain es troba amb els serveis financers

Reddit esquerra la companyia d'IA Anthropic per u…

Reddit ha presentat una demanda contra l'empresa d'intel·ligència artificial Anthropic als tribunals superiors de Califòrnia.

La transformació de la blockchain de novetat de n…

“El Bitcoin: Un sistema de diners electrònic peer-to-peer”, el document de 2009 de Satoshi Nakamoto que va introduir un sistema de pagaments descentralitzat com a alternativa a la banca tradicional, no va tenir èxit immediat.

Tots ja estan utilitzant la IA (i amagat)

Aquest article, destacat al butlletí One Great Story de Nova York, explora el rol creixent de la intel·ligència artificial a Hollywood, centrant-se en Asteria Film Co., un nou estudi d’IA fundat per l’emprenedor Bryn Mooser i l’actriu Natasha Lyonne.

Blockchain en l'educació: assegurant els crèdits …

Les institucions educatives a nivell mundial adopten cada vegada més la tecnologia blockchain per garantir i verificar les credencials academics, amb l’objectiu d’abordar la seva falsificació i reforçar la confiança en els registres acadèmics.

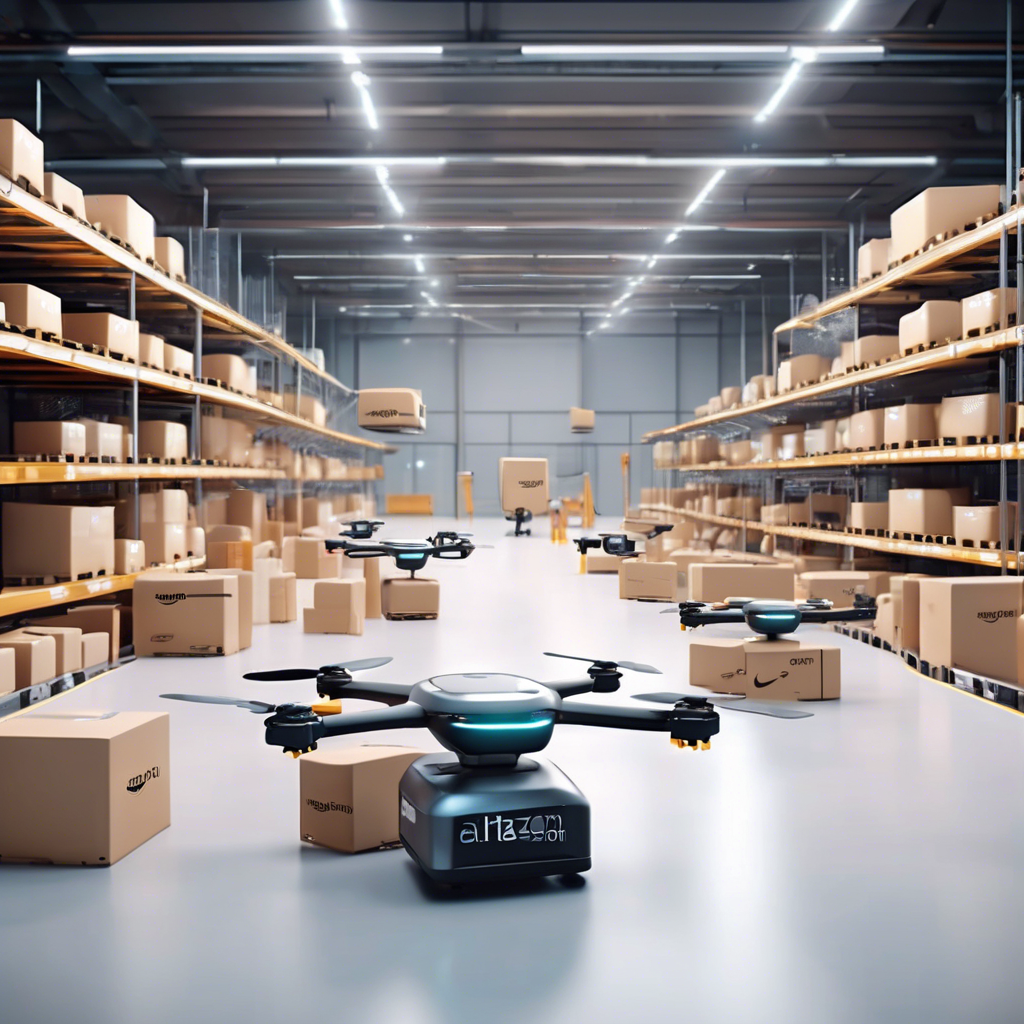

La distribució i la logística d'Amazon reben un i…

Amazon ha anunciat una gran expansió en l’ús de la intel·ligència artificial per millorar les entregues i la logística, marcant un avenç important en la integració de tecnologia d'avantguarda dins de la seva cadena de subministrament.

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift