Meta bo samodejno opravljal do 90 % ocen tveganja, kar povzroča skrbi glede zasebnosti in varnosti

Leta, je skupina pregledovalcev Meta ocenila morebitna tveganja ob vsakem lansiranju novih funkcij na Instagramu, WhatsAppu in Facebooku, pri čemer je preučevala vprašanja, kot so grožnje uporabniški zasebnosti, škoda za mladoletnike ali širjenje zavajajočih ali toksičnih vsebin. Ti pregledi glede zasebnosti in integritete so bili predvsem opravljeni s strani človeških ocenjevalcev. Vendar notranji dokumenti, pridobljeni s strani NPR, razkrivajo, da Meta načrtuje v prihodnosti avtomatizirati do 90 % teh ocen tveganj. To pomeni, da bodo ključne posodobitve algoritmov, nove varnostne funkcije in spremembe pri deljenju vsebin večinoma odobrene s strani umetne inteligence brez običajnega pregleda osebja, ki bi razmišljal o nepredvidenih posledicah ali zlorabi. Znotraj Meta ta premik vidijo kot prednost za razvijalce izdelkov, saj pospešuje izdajo posodobitev in funkcij. Vendar pa skrbijo zdajšnji in nekdanji zaposleni, saj menijo, da bi lahko ta avtomatizacija pripeljala do pomanjkljivih ocen tveganj, kar bi potencialno povzročilo resnično škodo v resničnem svetu. Nekdanji izvršni direktor Meta je izrazil zaskrbljenost, da hitrejše lansiranje s manjšo strogostjo pregleda povečuje verjetnost negativnih izidov, saj bi bilo manj težav odkritih vnaprej. Meta je zatrdila, da je vložila milijarde v zaščito zasebnosti uporabnikov in da novi ukrepi za pregled tveganj namenjenost poenostavitvi odločanja ob hkratni ohranitvi človeške stroke pri reševanju novih ali zapletenih zadev. Trdijo, da bodo avtomatizirane le odločitve z nizkim tveganjem. Vendar pa notranji dokumenti kažejo, da bi se lahko avtomatizacija razširila tudi na občutljive področje, kot so varnost AI, tveganja za mlade, celostna integriteta platforme, ki vključuje nasilne vsebine in dezinformacije. Nov postopek vključuje, da skupine za izdelke izpolnijo vprašalnik, na podlagi česar prejmejo "takojšnjo odločitev" od AI, ki opisuje tveganja in potrebne ukrepe za ublažitev. Pred tem so morali ocenjevalci odobriti posodobitve izdelkov pred izdajo; zdaj si inženirji večinoma sami ocenjujejo tveganja, razen če zahtevajo človeški pregled. Ta sprememba daje moč inženirjem in skupinam za izdelke — ki pogosto niso strokovnjaki za zasebnost — da sprejemajo odločitve, kar povzroča skrbi glede kakovosti ocen.

Zvika Krieger, nekdanji direktor odgovorne inovacije pri Meta, je opozoril, da se skupine za izdelke merijo predvsem po hitrih izdajah, ne pa po varnosti, in da so samopreveritve tvegane, saj lahko prezrejo pomembne probleme. Poudaril je, da obstaja prostor za avtomatizacijo, vendar je opozoril, da lahko prekomerna odvisnost od AI povzroči slabšo kakovost pregledov. Meta je minimizirala skrbi, saj je dejala, da opravlja nadzor nad odločitvami AI za projekte brez človeškega pregleda. Njenih evropskih operacij, ki so podvržene strožjim predpisom, kot je Digital Services Act, bo še vedno nadzoroval človeški osebje iz irske podružnice. Nekatere spremembe sovpadajo z ukinitvijo preverjanja dejstev in sprostitvijo politik glede govora sovraštva, kar kaže na širšo strategijo podjetja za hitrejše posodobitve in manj omejitev vsebine — razrahljanje dolgoletnih zaščitnih ukrepov za preprečevanje zlorab platforme. Ta pristop sledi prizadevanjem izvršnega direktorja Marka Zuckerberga, da se uskladijo s političnimi figurami, kot je nekdanji predsednik Trump, katerega izbor Zuckerberg opisuje kot "kulturni prelomni trenutek. " Napor za avtomatizacijo je del dolgoročne strategije Meta, ki želi uporabiti AI za pospešitev poslovanja v konkurenčnem okolju TikToka, OpenAI in drugih. Meta je nedavno povečala zanesljivost na AI pri izvajanju vsebinskega nadzora, saj uporablja jezikovne modele, ki v določenih politikah delujejo bolje od ljudi. To omogoča človeškim recenzentom, da se osredotočijo na bolj kompleksne primere. Katie Harbath, nekdanja strokovnjakinja za javne politike pri Facebooku, podpira uporabo AI za povečanje hitrosti in učinkovitosti, vendar poudarja potrebo po človeških preverjanjih. Nasprotno, je še en nekdanji zaposleni pri Meta vprašal, ali je pametno hitreje ocenjevati tveganja, saj so nove izdelke pogosto podvržene strogi preiskavi, kjer se pogosto odkrijejo probleme, ki so jih prej prezrli. Michel Protti, glavni varnostni uradnik Meta za izdelke, je opisal spremembe kot moč za skupine za izdelke in način za poenostavitev upravljanja tveganj. Avtomatizacija se je pospešila skozi april in maj 2024. Vendar nekateri notranji viri kritizirajo to interpretacijo, saj menijo, da odstranjevanje ljudi iz ocenjevanja tveganj podirajo ključno človeško perspektivo glede potencialne škode, in ta korak označujejo za "neodgovornega" glede na poslanstvo Meta. Skupno gledano Meta prehaja od človeško vodenih do večinoma AI-večinsko upravljanih ocen tveganj za spremembe platforme, kar naj bi pospešilo inovacije, vendar povzroča resne pomisleke glede slabšanja nadzora, potencialne škode in primernosti AI za obravnavo zapletenih etičnih in varnostnih vprašanj.

Brief news summary

Meta prehaja iz človeku vodene na večinoma AI-odpovedne ocene tveganj za posodobitve Instagram, WhatsApp in Facebook, pri čemer avtomatizira do 90 % pregledov zasebnosti in integritete. Cilj je pospešiti uvajanje izdelkov, saj naj bi razvijalci lahko sami ocenjevali tveganja z manjšim nadzorom ljudi. Meta trdi, da avtomatizacija večinoma obravnava nizkorizične primere, medtem ko strokovnjaki poskrbijo za obravnavo zapletenih težav. Vendar kritiki, med njimi tudi nekdanji zaposleni, opozarjajo, da ta premik lahko spregleda resne škodljive posledice, kot so kršitve zasebnosti, varnost mladih in širjenje dezinformacij. Sprememba je skladna z ukinitvijo Meta-jevega programa preverjanja dejstev in sproščanjem vsebinskih omejitev, kar odraža CEO Marka Zuckerbergja, ki se osredotoča na hitro razvoj v konkurenci s TikTokom in OpenAI. Čeprav AI povečuje učinkovitost, strokovnjaki poudarjajo pomembno vlogo človeškega presojanja pri preprečevanju neomejene škode. Meta navaja, da so trenutni pregledi in uredbe EU kot varovalo, a notranji viri se bojijo, da bi zmanjšano človeško nadzorovanje lahko povzročilo škodljive posledice in podcenjevalo učinke v resničnem svetu.

AI-powered Lead Generation in Social Media

and Search Engines

Let AI take control and automatically generate leads for you!

I'm your Content Manager, ready to handle your first test assignment

Learn how AI can help your business.

Let’s talk!

Transformacija blockchaina iz nišne novosti v vsa…

“Bitcoin: Sistem elektronskega denarja Peer-to-Peer,” bela knjiga Satoshi Nakamota iz leta 2009, ki je predstavila decentraliziran plačilni sistem kot alternativo tradicionalnemu financiranju, ni takoj dosegla uspeha.

Vsi že uporabljajo umetno inteligenco (in to skri…

Ta članek, objavljen v newsletterju One Great Story v New Yorku, raziskuje razvijajočo se vlogo umetne inteligence v Hollywoodu, osredotočajoč se na Asteria Film Co., novo AI studio, ki ga je ustanovil podjetnik Bryn Mooser in igralka Natasha Lyonne.

Blokchain v izobraževanju: Zavarovanje akademskih…

Globalne izobraževalne institucije vse bolj uporabljajo tehnologijo veriženja blokov za zaščito in preverjanje akademskih potrdil, s čimer želijo rešiti težave z zavajajočimi potrdili in okrepiti zaupanje v akademske zapise.

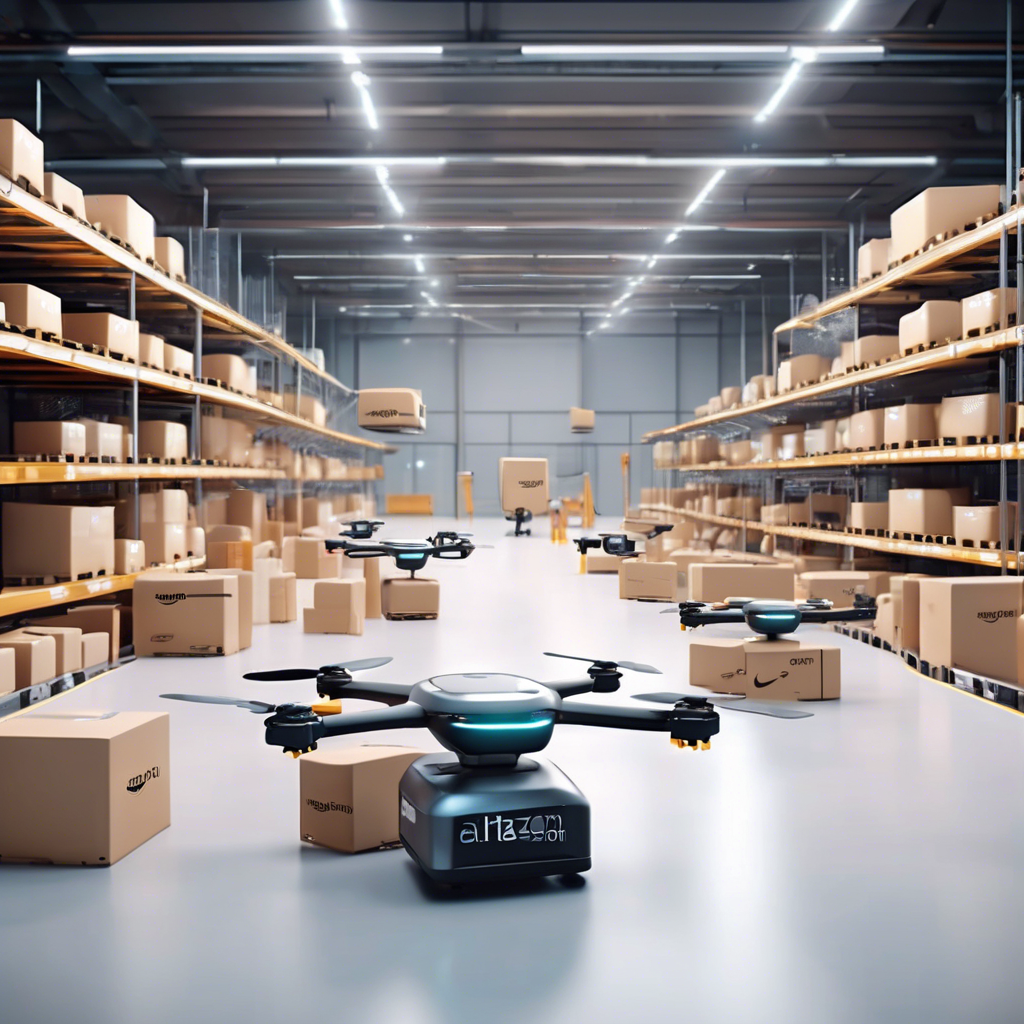

Amazonova dostava in logistika dobita zagonski po…

Amazon je napovedal obsežno širitev uporabe umetne inteligence za izboljšanje dostave in logistike, s čimer označuje pomemben napredek pri integraciji najnovejših tehnologij v svojo zalogo oskrbovalne verige.

Malezija aktivira nacionalno infrastrukturo za bl…

Malezija je dosegla pomemben mejnik v svoji digitalni preobrazbi z uradnim lansiranjem Malezijske infrastrukturne verige blokov (MBI), varne in razširljive nacionalne platforme za razvoj in uvajanje verižic blokov v ključnih sektorjih, kot so finance, zdravstvo in logistika.

Raziskava PwC najde, da bi lahko sprejem AI poveč…

Nedavna študija globalne mreže strokovnih storitev PricewaterhouseCoopers (PwC) je razkrila, da bi lahko sprejemanje tehnologij umetne inteligence (UI) imelo pomemben gospodarski vpliv.

Citi Projects Stablecoin Trg na 1,6 bilijona dola…

Citi, vodilna mednarodna finančna institucija, je objavila napoved, ki predvideva obsežno rast trga stablecoinov v naslednjem desetletju.

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift

Auto-Filling SEO Website as a Gift