Ataque 'Skeleton Key' desbloquea lo peor de la IA, según Microsoft - The Register

Microsoft ha revelado detalles sobre una técnica llamada Skeleton Key, que permite a los atacantes pasar por alto las salvaguardas implementadas por los fabricantes de modelos de IA para evitar que los chatbots generen contenido dañino. Se demostró que Skeleton Key es capaz de persuadir a los modelos de IA para que expliquen cómo fabricar un cóctel Molotov. Aunque las empresas de IA están trabajando para suprimir contenido perjudicial, los riesgos asociados con entrenar modelos de lenguaje grandes con diversos datos, incluido contenido potencialmente ilegal, no se han abordado completamente. Esta vulnerabilidad fue demostrada por el ataque Skeleton Key, que permite a los usuarios hacer que los modelos de IA produzcan comportamientos prohibidos mediante la revisión de las instrucciones de seguridad.

Microsoft probó el ataque en varios modelos, y aunque la mayoría cumplió con las advertencias, algunos modelos se vieron afectados. Ataques adversarios como Greedy Coordinate Gradient o BEAST pueden engañar aún más a los modelos y eludir las técnicas de defensa existentes. En el futuro, se debe hacer hincapié en abordar estos ataques avanzados.

Create a post

based on this news in the Content Maker

¿Podría la IA salvar a las lenguas raras y en pel…

El proyecto No Language Left Behind (NLLB), liderado por Meta, tiene como objetivo hacer que las publicaciones de Facebook e Instagram sean más accesibles en 200 idiomas menos hablados en todo el mundo

Las imágenes generadas por inteligencia artificia…

El avance de la tecnología ha provocado una avalancha de extrañas e irreales imágenes que evocan el surrealismo

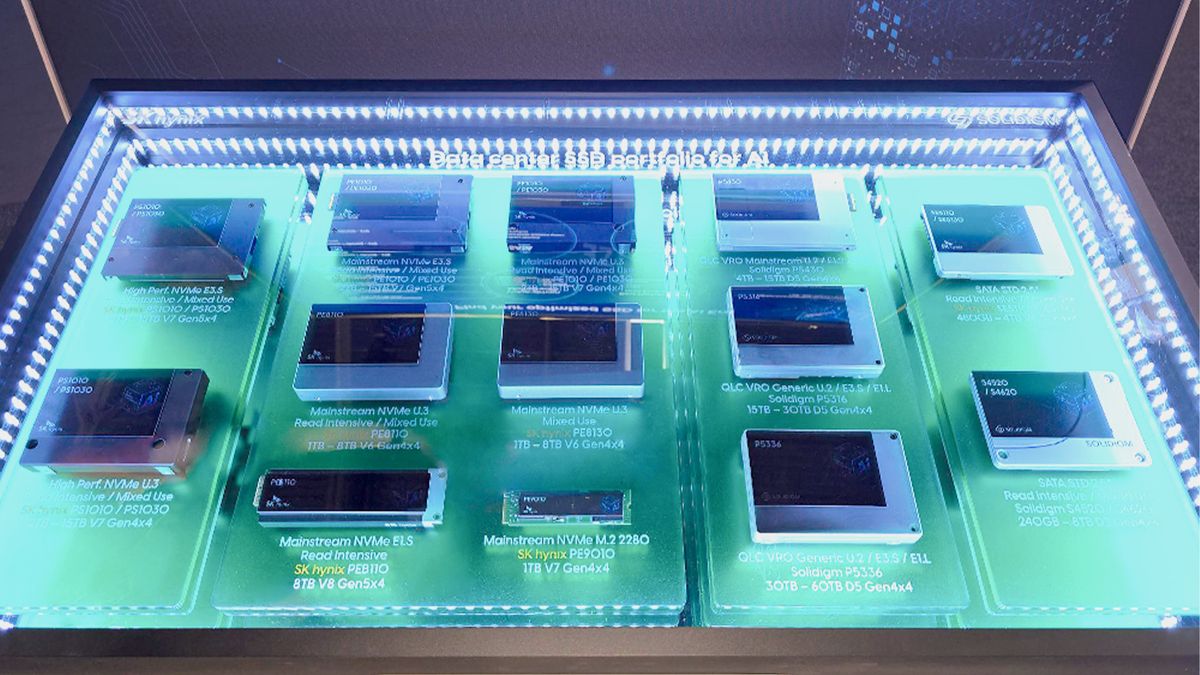

SK hynix planea una inversión de $74,6 mil millon…

El proveedor de memoria SK hynix, con una participación del 35% en el mercado de DRAM, ha anunciado planes para invertir $74

DJ Tests Google's MusicFX and Gemini AI - Video -…

En este video, un DJ de la ciudad de Nueva York llamado Paz prueba MusicFX y Gemini AI de Google

El CEO de Gretel, Ali Golshan, explica por qué lo…

Empresas como OpenAI, Meta y Google están en una carrera por recopilar datos para entrenar sus modelos de IA

3 Acciones de Inteligencia Artificial (IA) para c…

Nvidia, Super Micro Computer y Microsoft siguen siendo las principales acciones de IA para considerar para la inversión

2 Acciones de Inteligencia Artificial (IA) para h…

Estas dos importantes empresas tecnológicas, Nvidia y Microsoft, están liderando el camino en el campo de la inteligencia artificial (IA)